A la une

Observer un système quantique le perturbe. L’acte de mesurer peut ainsi devenir une nouvelle manière de transférer de l’énergie et permet l’invention de nouveaux types de moteurs quantiques.

Thermodynamique : de l’énergie à l’entropie

Au 19ème, la thermodynamique optimise le fonctionnement des machines à vapeur. L’objectif est de convertir un flux de chaleur[1] en puissance utile, c’est-à-dire en travail. Au cours de cette conversion, bien que la quantité totale d’énergie soit conservée, nous obtenons moins d’énergie sous forme de travail que nous en avions sous forme de chaleur. La conversion n'est donc pas totale.

À l’inverse, le travail lui, peut être entièrement converti en chaleur. La conversion d’énergie a donc une direction privilégiée, allant du travail vers la chaleur, la transformation inverse s’accompagnant de “pertes” inévitables.

Le travail peut être échangé de manière réversible, mais pas la chaleur qui « apparaît comme une forme dégradée d’énergie », Alexia Auffèves, Directrice de Recherche CNRS.

Cette différence entre les formes d’énergie est liée au degré de désorganisation microscopique du système, caractérisé par la notion d’entropie.

« Le travail est une forme d’énergie bien plus ordonnée que la chaleur », nous explique Léa Bresque, ancienne doctorante à l’Institut Néel.

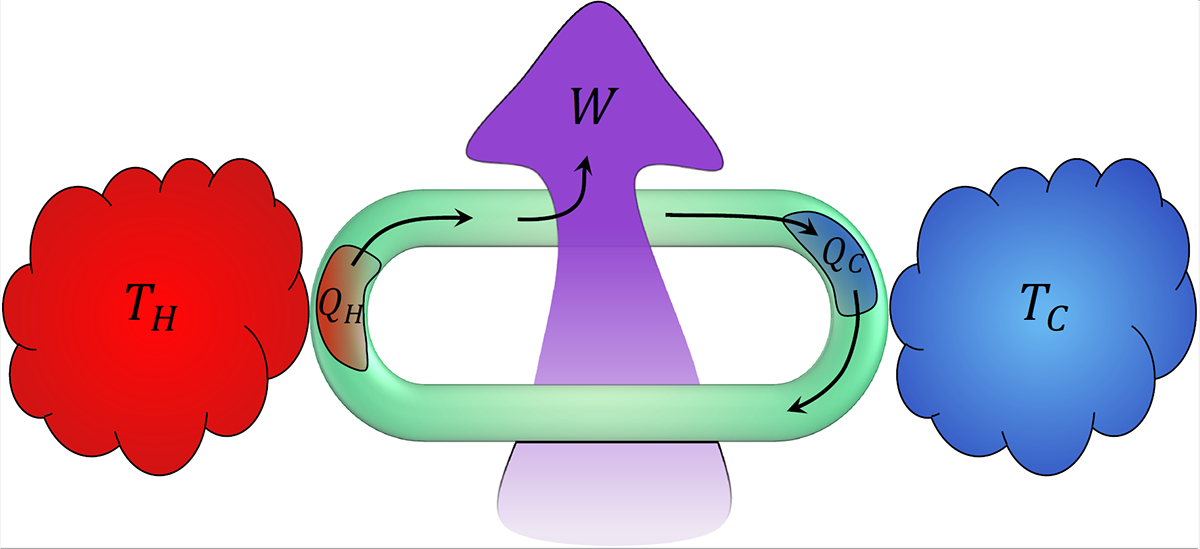

Schématisation d’un cycle thermodynamique. Classiquement, le cycle thermodynamique d’un moteur vise à extraire un travail W à partir d’un flux de chaleur. Dans cette illustration, le réservoir chaud fournit une quantité Qh dont le réservoir froid va récupérer la quantité Qc, la différence correspondant au travail W. Ce travail ne peut cependant pas excéder la valeur ncQh, où nc ≤ 1 est l’efficacité de Carnot. © Léa Bresque - Institut Néel

Ainsi, lorsque du travail est converti en chaleur, l’entropie du système augmente. Or, comme nous l’indique le second principe de la thermodynamique, augmenter l’entropie est simple, il suffit souvent de ne rien faire. Par contre, diminuer l’entropie nécessite toujours plus de moyens.

Pour générer du travail, les moteurs thermiques exploitent la différence de température de deux fluides : souvent l’air ambiant froid et l’air chaud produit par une combustion. Or en entrant en contact, ces fluides tendent naturellement vers une température moyenne, un équilibre thermique. L’entropie devient alors maximale, de même que notre ignorance sur l’état du système (ici le mélange des deux fluides), au niveau microscopique.

Avec le démon de Maxwell, exploiter l’information pour réduire l’entropie

Plus l’entropie d’un système est faible, meilleure est notre connaissance de la répartition microscopique des atomes. Or cette information peut être très utile ! Le physicien écossais James Clerk Maxwell l’a illustré en 1867, dans une célèbre expérience de pensée : il imagine un démon doté d’une connaissance parfaite de l’état de chaque particule d’un fluide à l’équilibre thermique.

Dans un fluide chaud les particules sont en moyennes plus rapides. Le démon peut donc répartir les particules selon leur vitesse et obtenir deux fluides de températures différentes.

Nous avons vu que l’on pouvait extraire du travail de deux fluides de températures différentes. Ainsi, simplement grâce à l’information dont il dispose, le démon pourrait modifier un système pour en extraire de l’énergie.

Cela semble a priori paradoxal, car on pourrait alors extraire du travail indéfiniment, sans même disposer d’un flux de chaleur au départ, en partant d’un unique fluide à l’équilibre thermique. Or cela est incompatible avec le second principe de la thermodynamique.

Pour résoudre cet apparent paradoxe, il faut comprendre que l’information n’est pas une simple abstraction : elle a besoin d’un support physique (la mémoire) initialisée d’une manière compatible avec le stockage d’information ; et pour cela il faut disposer d’énergie.

Dans nos ordinateurs : l’unité d’information est le bit. Un bit peut prendre deux valeurs distinctes (0 ou 1) correspondant à l’un des deux états physiques possibles d’un transistor. À la fin de chaque calcul, l’ordinateur consomme de l’énergie pour réinitialiser un bit, avant d’initier le calcul suivant.

Lorsque l’on réinitialise un système, on cherche à diminuer son entropie : même si l’on ignore le résultat du précédent calcul, et donc que l’entropie de nos bits est maximale, on veut que nos bits reviennent dans un état bien contrôlé (par exemple uniquement des 0), pour pouvoir lancer un nouveau calcul.

Or le second principe de la thermodynamique nous apprend que l’entropie peut augmenter spontanément, mais pas diminuer, à moins de dépenser de l’énergie.

Ainsi, le démon pourra extraire de l’énergie de son réservoir mais au prix d’une augmentation de l’entropie de ses bits de mémoire, qu’il ne pourra pas réinitialiser tout seul, c’est-à-dire sans apport d’énergie extérieure.

Que se passe-t-il lorsque le système est assez isolé pour exhiber des propriétés quantiques ? Quel est l’impact de la mesure et de l’information dans ces conditions et comment observer en pratique ces phénomènes ?

Vers un démon de Maxwell quantique : l’électrodynamique en cavité

Dans un ordinateur quantique, les bits deviennent des qubits : ce sont les différents états possibles de particules quantiques qui supportent les différentes variables.[2]

Grâce aux dispositifs de l’électrodynamique quantique en cavité, les chercheurs peuvent piéger et manipuler des photons pour implémenter des expériences où l’information et l’énergie sont manipulées à la manière d’un démon de Maxwell, mais cette fois-ci dans le cadre de systèmes quantiques.

« L’électrodynamique quantique en cavité est l’étude de l’interaction lumière matière lorsque celles-ci se réduisent à leurs formes les plus simples : un à quelques émetteurs quantiques pour la matière, quelques photons pour la lumière. » Alexia Auffèves

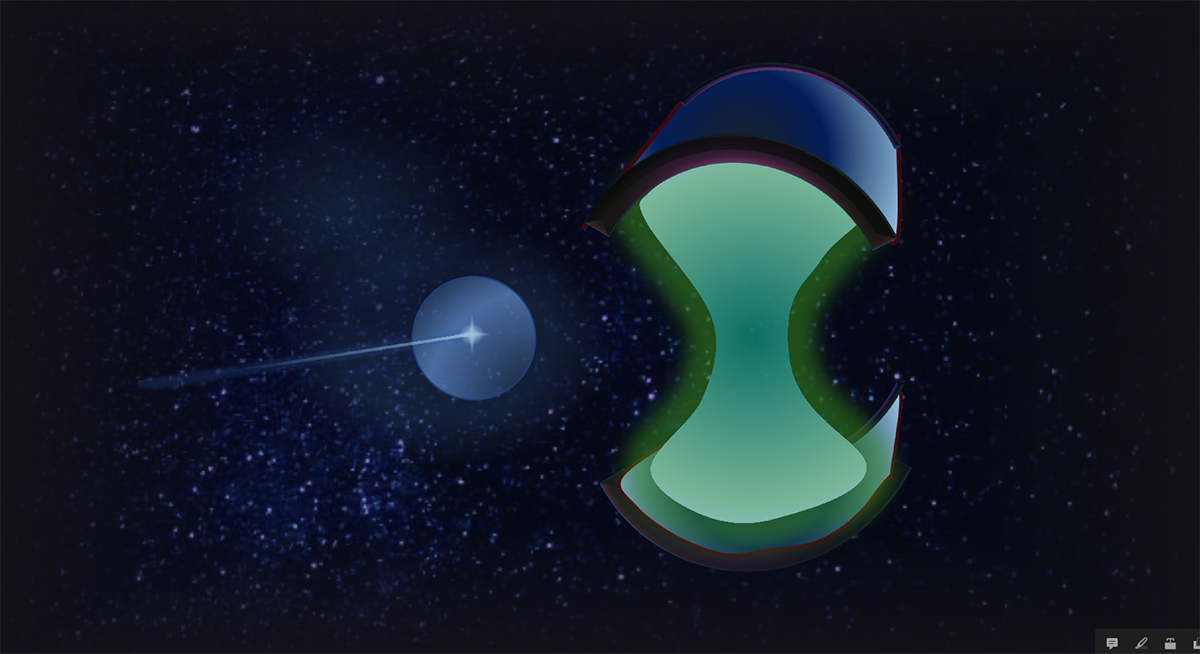

Illustration d'un atome envoyé dans une cavité. Lorsqu'un atome traverse une cavité optique, son interaction avec le champ qu'elle contient induit une évolution de l'état de l'atome et un potentiel échange énergétique avec eux. © Léa Bresque - Institut Néel

Les photons confinés dans une cavité peuvent ainsi témoigner de l’évolution microscopique d’un système donné (un atome par exemple). La « cavité » devient une sorte de démon de Maxwell quantique, dont on peut observer la « mémoire » en temps réel.

Le bruit quantique comme source de d’énergie

La thermodynamique quantique étudie les transferts d’énergie et d’entropie entre des particules subatomiques : électrons, protons, neutrons, photons.

Les systèmes quantiques peuvent se trouver dans un « état de superposition », c’est-à-dire posséder plusieurs valeurs pour une même grandeur observable, chacune étant associé à un état. Or mesurer cette grandeur détruit cette superposition et place aléatoirement le système dans l’un de ces états : elle le perturbe.

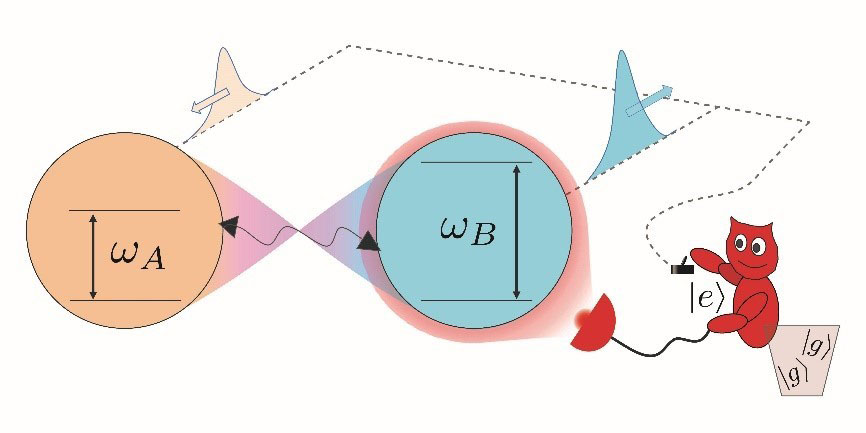

Le qubit de plus basse énergie (rouge) absorbe un photon. Puis le photon est échangé entre les deux qubits, qui deviennent intriqués. Enfin, une mesure effectuée sur l'un des qubits peut projeter le photon dans le qubit de plus haute énergie (bleu), d'où un gain d'énergie. © Alexia Auffèves - Institut Néel

L’équipe de recherche Qu-Dice[3] à l’Institut Néel[4] est parvenue à caractériser ces perturbations, ce « bruit quantique », comme une ressource énergétique capable d’alimenter des moteurs quantiques inédits. C’est l’acte de mesure qui permet ici de transférer de l’énergie au système.

« En physique quantique, mesurer un système perturbe aléatoirement son état, ce qui conduit à des fluctuations énergétiques, comme si on mettait le système en contact avec une source chaude. Ces perturbations induites par la mesure quantique, en d’autres termes ce hasard quantique, sert de « fuel » sans équivalent classique pour des moteurs d’un nouveau type. » Alexia Auffèves.

Le bruit quantique remplace le bruit thermique (fluctuation des sources chaudes ou froides) comme source d’énergie et d’entropie. Des « moteurs à mesure », récemment concrétisés, démontrent la réalité physique de ce transfert d’énergie que les chercheurs ont décidé d’appeler « chaleur quantique »[5].

Pour élucider les conséquences énergétiques de la mesure quantique, l’équipe Qu-Dice a conçu un moteur à mesure quantique composé de deux qubits.

Dans ce type de moteur, la perturbation induite par l’acte de mesure a pour conséquence un gain d’énergie, correspondant à un photon supplémentaire.

Pourtant, la physique quantique respecte la loi de conservation de l'énergie.

« Dans ces moteurs quantiques, l’énergie ne provient bien sûr pas de nulle part, il ne s’agit pas d’une nouvelle source d’énergie mais plutôt d’un nouveau moyen de transférer de l’énergie. » Léa Bresque.

L’un des enjeux majeurs du projet QU-DICE était de comprendre les implications de la mesure quantique et de caractériser son empreinte énergétique.

La mesure quantique ne constitue pas une ressource énergétique venue de nulle part et les moteurs quantiques ne remplaceront pas les moteurs thermiques. Mais ces recherches fondamentales promettent d’optimiser la consommation énergétique des technologies quantiques de demain.

Consultez aussi :

1905 : Einstein inaugure l’ère quantique

La cryptographie face à la menace quantique

Moteurs quantiques : quand la mesure devient vecteur d’énergie

« Ces expériences ont validé l’étrange description du monde donnée par la mécanique quantique »

Pascale Senellart, au cœur de la révolution quantique

_ _ _

Ces recherches ont été financées en tout ou partie, par l’Agence nationale de la recherche (ANR) au titre du projet ANR-Qu-DICE-AAPG2018. Cette communication est réalisée et financée dans le cadre de l’appel à projet Sciences Avec et Pour la Société - Culture Scientifique Technique et Industrielle pour les projets JCJC et PRC des appels à projets génériques 2018-2019 (SAPS-CSTI-JCJC et PRC AAPG 18/19).

_ _ _

[1] Ce flux de chaleur opère le plus souvent entre un réservoir, maintenu au chaud grâce à une combustion, et un environnement extérieur froid.

[2] La variable 0 correspond à l’état de plus basse énergie, 1 à l’état « excité », de plus haute énergie. Au départ, on prépare le système de telle sorte qu’il soit dans un état de superposition ((\ket{0}+\ket{1})/\sqrt{2}" et "(\ket{0}-\ket{1})/\sqrt{2}). Ces superpositions caractérisent des états « intriqués ».

[3] « QU-DICE est un acronyme autour des mots QUantum thermoDynamics In Cavity quantum Electrodynamics. L’idée est de jouer avec le mot « Dice », dé en anglais, car la thermodynamique et la physique quantique sont deux sciences du hasard. » Alexia Auffeves

[4] L'Institut Néel est un laboratoire CNRS grenoblois de recherche fondamentale en physique de la matière condensée.

[5] Benjamin Huard, ENS Lyon, Quantum Circuit group.