Vous êtes ici

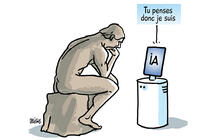

Pourquoi les assistants virtuels ont besoin d'un corps

Une fois par mois, retrouvez sur notre site les Inédits du CNRS, des analyses scientifiques originales publiées en partenariat avec Libération.

Ces derniers mois ont vu fleurir les assistants virtuels, qu’il s’agisse d’Alexa pour Amazon ou de Google Home assistant et de sa dernière version « duplex », qui se propose carrément de passer des appels à notre place pour prendre rendez-vous chez le coiffeur ou le médecin… Si séduisantes qu’elles puissent être pour le Terrien de 2019, ces voix désincarnées sont pourtant loin de ce que pourraient être ces assistants dans le futur : des êtres virtuels possédant un corps et un visage pour mieux faire passer leur message, capables de décrypter notre humeur et de nouer des relations avec nous pour mieux répondre à nos besoins.

Créer de tels êtres demande un long travail de recherche, si l’on veut éviter les « Désolé, je ne vous comprends pas » ou les « Je suis désolé, je ne sais pas comment vous aider avec cela », que nous opposent régulièrement les assistants d’aujourd’hui. La communication est en effet bien plus qu’un échange d’informations. Ce n’est pas une simple série de questions-réponses, comme peut le faire le système d’intelligence artificielle Watson, lancé en 2017 par IBM (le logiciel se propose de répondre en langage naturel aux questions que lui posent ses utilisateurs dans le domaine de la banque ou de la santé, par exemple).

Partout dans le monde, des laboratoires travaillent à la création d’êtres virtuels communicatifs et relationnels, capables de communiquer avec la voix, bien sûr, mais aussi avec des gestes, les expressions du visage et le regard pour indiquer à qui ils s’adressent. Pour y arriver, certains chercheurs se basent sur le travail d’acteur, d’autres font appel à des animateurs professionnels, d’autres – c'est notre cas – cherchent à comprendre le comportement humain dans la communication et dérivent de ces travaux les algorithmes qui seront ensuite implantés dans des êtres virtuels. Car les assistants virtuels créés grâce à l’analyse de l’interaction entre de vraies personnes ont, selon nous, toutes les chances d’être mieux appréciés, mieux compris et plus efficaces dans l’accomplissement de leurs tâches.

Pour concevoir nos êtres virtuels, nous étudions donc le comportement humain de façon rigoureuse. Nous utilisons des vidéos de personnes en conversation (à la télévision, en ligne, ou dans les archives scientifiques), ou nous mettons en scène des humains dans des situations les plus naturelles possible : par exemple, nous demandons à deux collégiens de seconde de travailler ensemble sur un devoir d’algèbre, ou à une personne de recommander un film à une autre. Ces vidéos visionnées seconde par seconde, parfois jusqu’à cent fois de suite, permettent d’analyser les comportements verbaux et non-verbaux et la façon dont ils s’articulent.

Le sourire complice

La question du sourire est un exemple intéressant : où trouve-t-on des sourires lors de ces interactions, et ont-ils toujours la même forme et la même signification ? Une étude a ainsi permis de montrer que lorsque deux collégiens travaillent l’algèbre, si l’un d’eux taquine l’autre, mais accompagne sa pique d’un sourire, leur niveau d’entente a tendance à s’élever et ils ont une propension à mieux apprendre. Mais quand la taquinerie n’est pas accompagnée par un sourire, le niveau d’entente tend à baisser et l’apprentissage à être moins fort. Le fait de taquiner, qui est une stratégie conversationnelle souvent perçue comme menaçante, peut donc aussi montrer que la relation entre deux interlocuteurs est privilégiée. La différence entre ces deux fonctions de la taquinerie est simplement signalée ici par le sourire.

Cette première théorisation nous a conduits à regarder les effets d’autres stratégies conversationnelles, par exemple la stratégie de l’imitation – hocher la tête quand l’autre hoche la tête, ou émettre des « hum » encourageants quand l’autre en émet… – et de les implémenter dans nos êtres virtuels de laboratoire afin de tester leur efficacité. En faisant varier les différents paramètres, on peut ainsi mesurer comment ces êtres sont perçus par leurs interlocuteurs humains.

Une question d'équilibre

Malgré une connaissance toujours plus fine des mécanismes qui sous-tendent la communication humaine, il reste illusoire de prétendre créer dès aujourd’hui un être virtuel qui soit en mesure de répondre à toutes les situations. Il devient en revanche envisageable d'en concevoir qui soient capables d’interagir dans des contextes précis. On peut ainsi imaginer des tuteurs virtuels destinés à l’apprentissage (d’une langue, de l’algèbre...), ou des compagnons virtuels capables d’aider par exemple une personne âgée à adopter les bons réflexes de santé prescrits par ses médecins.

Dans ce dernier cas, il se révèle indispensable de bien doser les impressions de chaleur et de compétence que ces compagnons virtuels peuvent produire sur les humains. Une étude a permis de montrer que beaucoup de sourires augmentaient certes l’impression de chaleur, mais faisaient baisser le niveau de compétence perçu ; alors que de petits mouvements rythmiques de la main renforçaient, eux, l’impression de compétence...

Même pour des applications précises, concevoir un être virtuel reste tout un art ! Mais pas seulement. Car se profilent des questions d’éthique auxquelles les chercheurs, mais aussi la société tout entière, devront répondre prochainement. Jusqu’à quel point a-t-on intérêt à créer un être virtuel capable de nouer des relations et de communiquer de manière totalement naturelle avec des êtres humains ? Ne doit-on pas au contraire leur garder une part d’imperfection, pour éviter que l’humain ne s’y attache trop, ou ne se fasse manipuler par un interlocuteur virtuel devenu trop habile ?

Se pose aussi la question délicate du stockage des données : pour répondre aux attentes de son utilisateur, un être virtuel devra d’abord analyser finement ses émotions, ses humeurs, ses besoins, et stocker ces informations. Qu’en fera l’entreprise qui commercialise l’assistant en question ? Que deviendront ces informations si elles sont piratées ou tombent entre de mauvaises mains ? Le cas récent des enregistrements d’Alexa utilisés à l’insu des utilisateurs par Amazon pour améliorer son service, donne matière à réflexion. ♦

Les points de vue, les opinions et les analyses publiés dans cette rubrique n’engagent que leur auteur. Ils ne sauraient constituer une quelconque position du CNRS.

----------------------------

À lire sur le même sujet :

- Demain, un ordinateur inspiré de notre cerveau ?

- Des machines enfin intelligentes ?

- Les robots ont-ils le sens de l'humour ?