Vous êtes ici

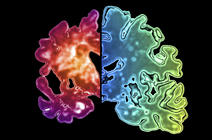

Demain, un ordinateur inspiré de notre cerveau?

Un neurone artificiel capable de reconnaître des chiffres prononcés par différentes personnes faisait l’objet d’une présentation très remarquée en septembre 2017. À l’heure des assistants intelligents de type Google Home et de la voiture autonome, pourquoi une performance aussi sommaire fut-elle annoncée comme une première mondiale par la célèbre revue Nature ?1 Parce que la révolution réside dans le composant lui-même : un neurone électronique, cylindre de métal mille fois plus fin qu’un cheveu et implémentable en circuit. Bref, un nano-neurone artificiel « en dur », à la différence de ces fameux réseaux de neuronesFermerUn réseau de neurones est un algorithme simulant numériquement le fonctionnement d’un réseau d’unités de calcul, les neurones formels, reliées entre elles par des connexions modifiables. Représentation simplifiée des neurones biologiques, ces neurones formels sont en fait des fonctions mathématiques qui, à partir des valeurs numériques reçues en entrée (connexions entrantes), calculent une valeur numérique de sortie (connexion sortante). virtuels qui, s’ils permettent actuellement de spectaculaires applications en intelligence artificielle (IA), désignent en réalité des fonctions mathématiques, des algorithmes, purement numériques et impalpables.

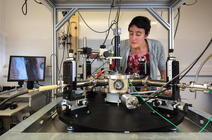

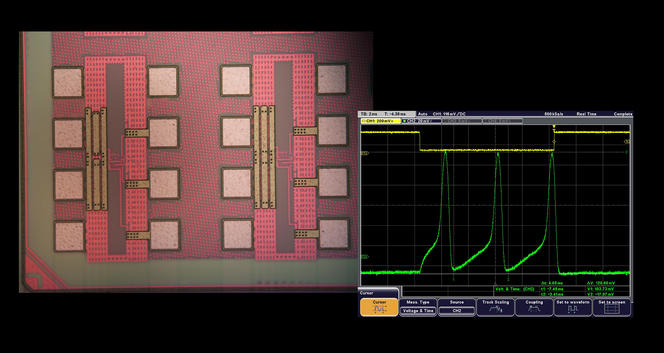

« D’autres nano-neurones artificiels “en dur” avaient déjà été mis au point, mais nous avons été les premiers à les faire fonctionner au sein d’une application », explique Julie Grollier, qui a dirigé ces travaux au sein de l’Unité mixte de physique CNRS-Thales2. Quelques mois plus tôt, en avril, un autre composant bio-inspiré était dévoilé dans Nature Communications3 par Vincent Garcia, chercheur au sein de la même unité, et ses collègues. Cette fois, il s’agissait d’une synapseFermerZones de contact entre les neurones. Elles se comportent comme des « boutons de connexion » et assurent la transmission des informations entre les cellules nerveuses. artificielle, inspirée de celles qui relient les neurones du cerveau.

Une grosse économie d’énergie

À quoi bon cette nouvelle quincaillerie électronique alors que les réseaux de neurones virtuels font déjà merveille en intelligence artificielle (IA) ? Parce que ces derniers, redoutables pour classifier de gigantesques masses de données, sont aussi effroyablement gourmands en énergie… Un gaspillage lié à la structure même des machines sur lesquelles ils turbinent.

« Les ordinateurs traditionnels sur lesquels on les fait tourner sont fondés sur une architecture datant des années 1950 qui sépare la mémoire et le “centre de calcul” en deux blocs bien distincts, explique ainsi Damien Querlioz, chercheur au Centre de nanosciences et de nanotechnologies4. Dès lors, un calcul, même simple, nécessite parfois d’aller chercher des données stockées très loin à l’échelle de la microélectronique. Or, les réseaux de neurones virtuels ont la particularité d’effectuer des calculs, certes très simples, mais en quantité massive et de manière parallèle avec souvent beaucoup de redondances ». D’où, parfois, de terribles « embouteillages » énergivores pour accéder à la mémoire… C’est ainsi que le programme AlphaGo, l’IA de Google qui a récemment écrasé les plus grands champions de go, consomme dix mille fois plus d’énergie qu’un humain à la même table de jeu !

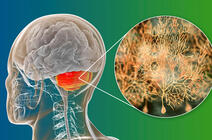

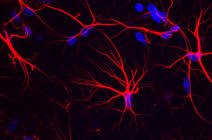

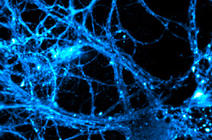

« Grâce à ses circuits neurone-synapse, notre cerveau, lui, dispose d’une mémoire (“stockée” dans les synapses) placée au plus proche du “centre de calcul” (que symbolisent les neurones) », explique Damien Querlioz. Cette architecture très distribuée s’avère extrêmement efficace pour traiter en parallèle la myriade d’opérations simples que nécessite la reconnaissance de sons ou d’images. En revanche, elle est moins adaptée au calcul classique : « Pour les opérations arithmétiques par exemple, qui font appel à moins de calculs, mais plus complexes, et exécutés les uns après les autres, l’architecture bien centralisée des ordinateurs traditionnels reste imbattable en précision », poursuit le chercheur.

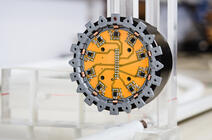

Si l’on parvient à construire des puces neuromorphiques, assemblage de composants artificiels mimant neurones et synapses biologiques, elles seront donc dédiées uniquement aux tâches d’IA où les excellents quoique trop dispendieux réseaux de neurones actuels sont cantonnés (reconnaissances de formes, de sons, etc.). Et l’éventuel ordinateur du futur qui en abriterait garderait précieusement ses microprocesseurs classiques. « En intégrant une puce neuromorphique, dédiée aux algorithmes de type réseau de neurones courants en IA, sur chaque processeur d’ordinateur ou de téléphone, on disposerait de processeurs moins énergivores », confirme Vincent Garcia.

Les géants de l’électronique ne s’y sont pas trompés : IBM, Intel, Qualcomm, tous développent leur propre puce neuromorphique. Leur approche peut sembler timide : neurones et synapses artificiels y sont construits à partir de transistors classiques en silicium. C’est également le parti pris d’Alain Cappy, de l’Institut de recherche sur les composants logiciels et matériels pour l’information et la communication avancée5.

« L’avantage de n’utiliser que des composants déjà existants est de pouvoir fabriquer plus rapidement des puces efficientes et industrialisables », commente le chercheur. Ce qui ne le dispense pas de toute originalité : là où les neurones de silicium mis en œuvre par les industriels nécessitent 20 à 30 transistors, l’équipe d’Alain Cappy a délibérément privilégié un modèle plus simple et économe de 6 transistors seulement. Résultat : « Il consomme cent fois moins d’énergie que les autres neurones artificiels du même type », se félicite le chercheur. Il fait également le pari d’une intégration totalement bio-inspirée : « L’idée est d’imiter le système yeux/cortex cérébral qui analyse si rapidement et efficacement l’image. Nous tentons ainsi d’intégrer ces neurones à la fois dans des capteurs visuels inspirés de la rétine biologique, et dans des puces de traitement agencées comme les colonnes de neurones de notre cortex cérébral », poursuit Alain Cappy. Cette architecture très interconnectée pourrait s’avérer performante pour l’implémentation de réseaux de neurones bien plus complexes et performants que les possibilités offertes par les solutions actuelles sous forme logicielle.

Une question de taille

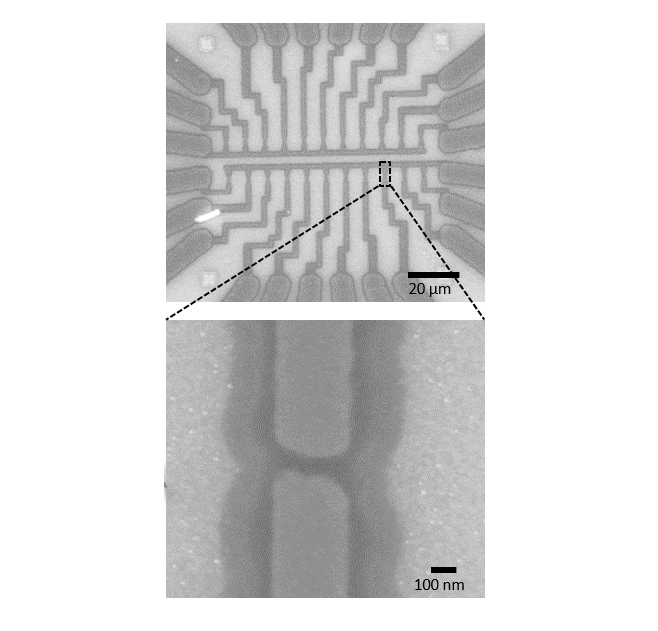

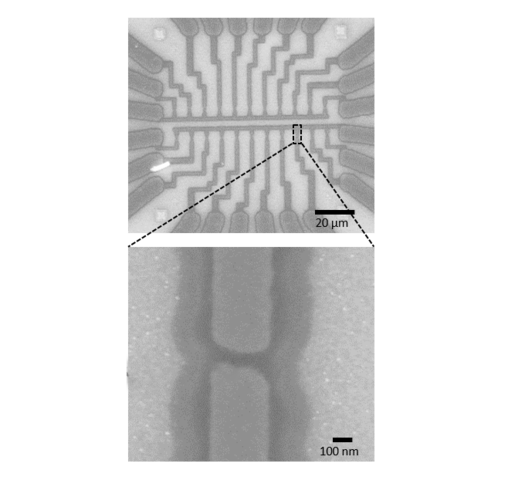

La plupart des chercheurs misent cependant sur une approche plus révolutionnaire pour fabriquer les composants bio-inspirés eux-mêmes. « Les neurones construits avec des transistors classiques mesurent 100 micromètres de côté tandis que le nôtre mesure à peine 100 nanomètres de diamètre : c’est mille fois plus petit », se réjouit Julie Grollier. Or, la question de la taille se posera de manière aiguë quand on voudra les assembler par millions et fabriquer des puces valables. Pour construire leur nano-neurone, les chercheurs de l’Unité mixte de physique CNRS-Thales ont choisi la spintronique, une discipline utilisant le spinFermerCaractéristique microscopique et purement quantique de l’électron, comparable à une aimantation. On peut ainsi se représenter, de manière schématique, un électron comme un petit aimant pouvant prendre seulement deux orientations : un spin « vers le haut » ou un spin « vers le bas ». des électrons comme unité d’information (alors que l’électronique utilise la charge électrique des électrons).

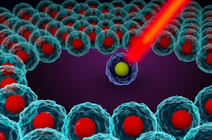

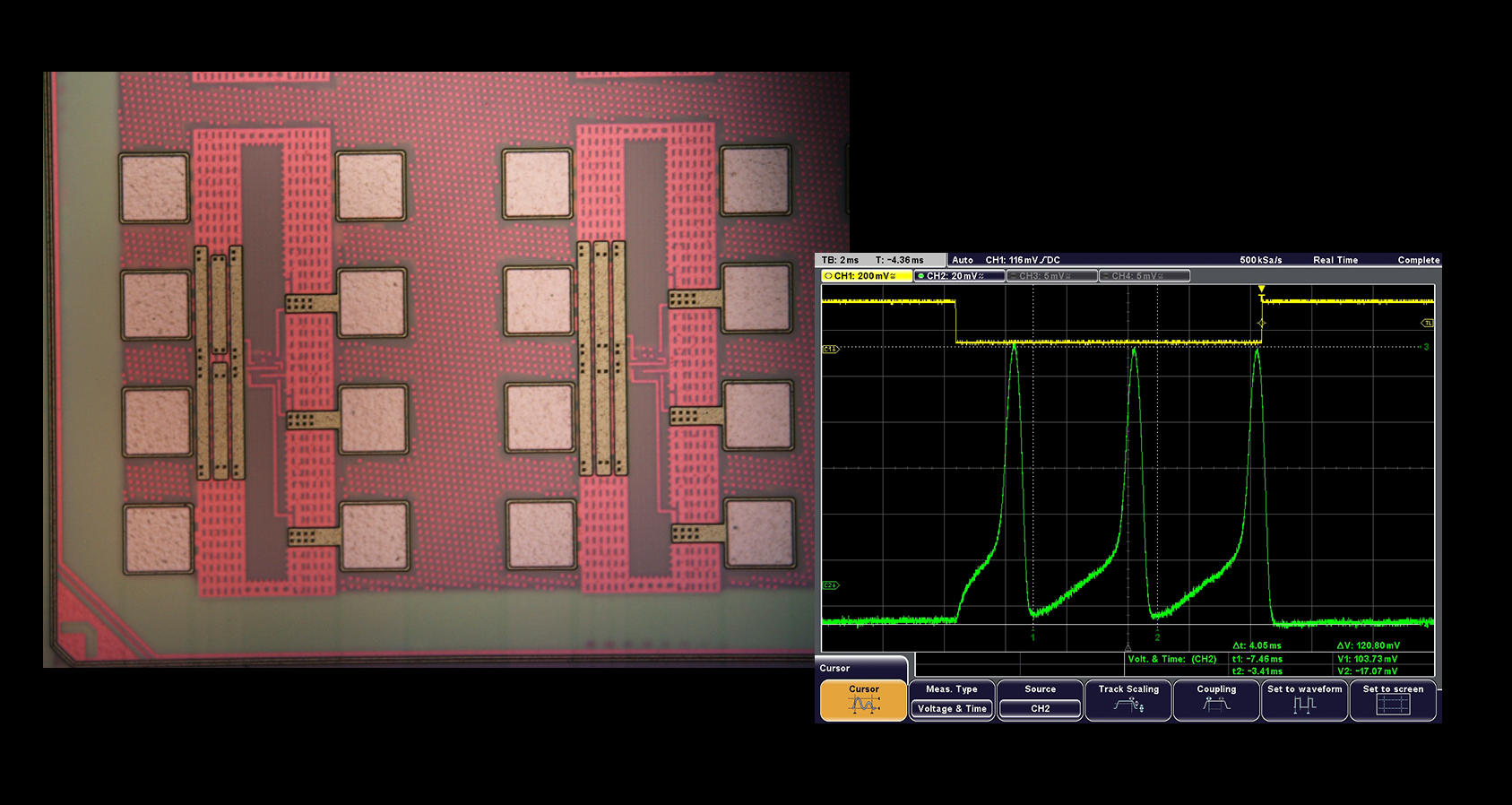

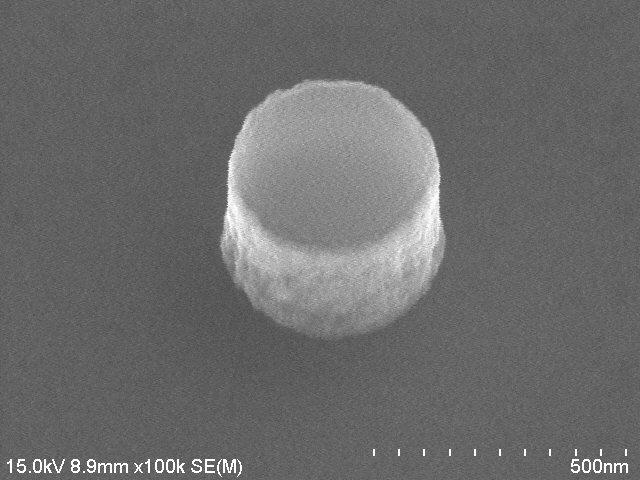

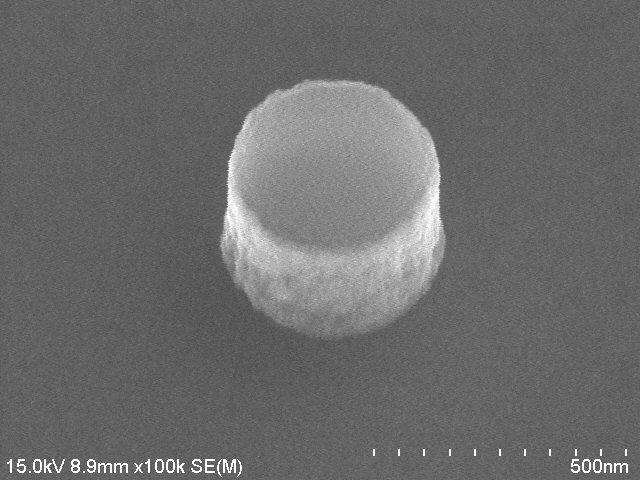

Le nano-neurone consiste en un empilement de deux couches de métaux ferromagnétiques prenant en sandwich une fine couche d’isolant électrique. « Lorsqu’on le soumet à un courant continu, les électrons passent à travers l’isolant par effet tunnelFermerPhénomène observé en mécanique quantique (c’est-à-dire à l’échelle des atomes) qui permet à une particule de traverser une barrière a priori infranchissable : elle franchit une barrière de potentiel même si son énergie est inférieure à l’énergie minimale requise. et leur spin fait tourner l’aimantation de la couche supérieure. Cela produit en sortie des oscillations électriques comparables aux signaux émis par les neurones de notre cerveau », résume Julie Grollier.

Pour développer leur propre nano-neurone, l’équipe de Laurent Cario, de l’Institut des matériaux Jean-Rouxel6, a de son côté misé sur les isolants de MottFermerMatériau isolant du fait d’une forte interaction répulsive entre électrons : il se produit alors une « localisation » de ces derniers qui restent « accrochés » aux atomes constituant le réseau cristallin. Le transport de charge n’étant plus possible, le solide devient un isolant. Cet état quantique échappe à la théorie des bandes qui néglige les interactions entre les électrons. Il fut découvert en 1949 par le Britannique Nevill Mott.. Ce matériau, dont le comportement physique est exploré dans le cadre de mémoires de nouvelles générations, pourrait constituer une alternative aux matériaux spintroniques : « Notre neurone a fait l’objet d’un brevet déposé en 2014 et nous essayons maintenant d’en améliorer la miniaturisation afin de faciliter son transfert industriel », précise Laurent Cario.

Imiter la plasticité des neurones

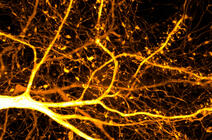

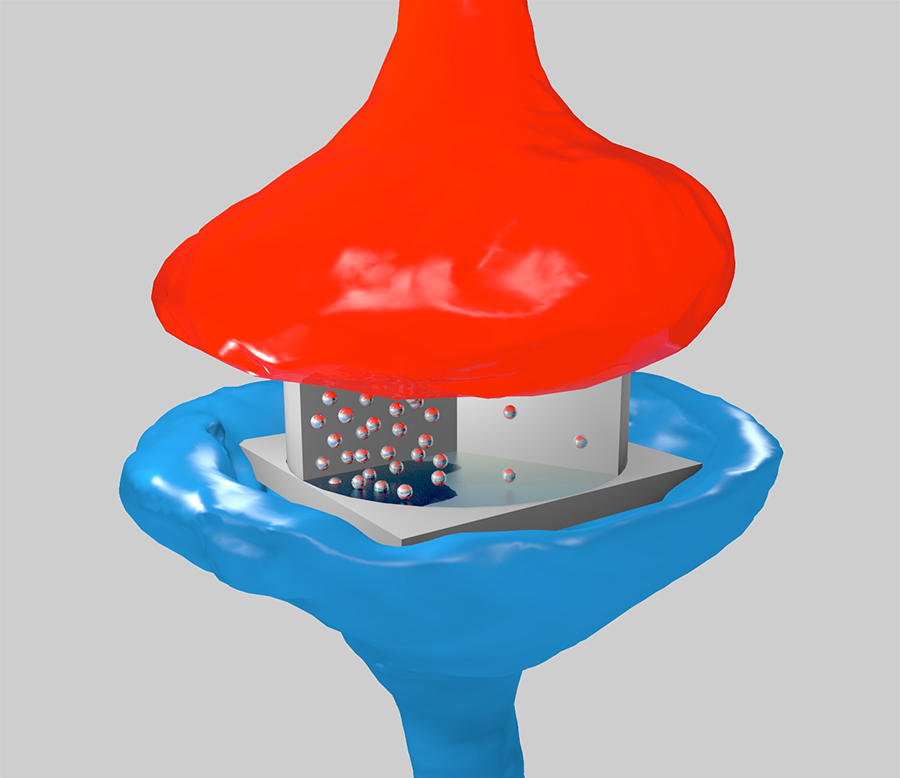

Présentes dans le cerveau en nombre dix mille fois plus important que les neurones, les synapses ont un rôle tout aussi capital. En particulier, les chercheurs tentent de reproduire une caractéristique de ces canaux interneurones : leur plasticité, c’est-à-dire leur capacité à se renforcer ou se déprécier au fil du temps pour favoriser le « câblage » entre les neurones utiles.

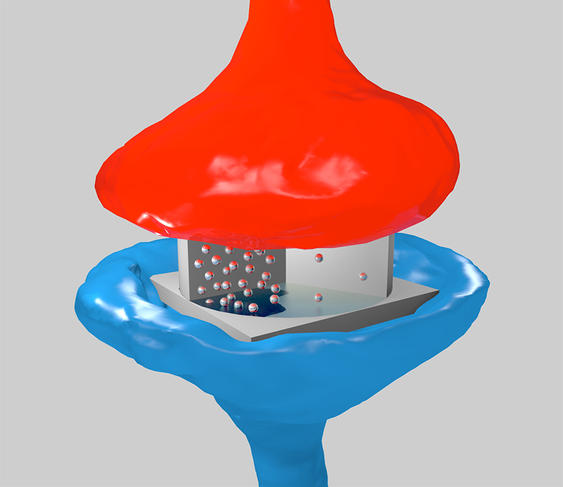

Pour y parvenir, Vincent Garcia et son équipe ont choisi une couche ultra-mince d’un matériau ferroélectrique que les électrons traversent par effet tunnel : « Nous avons démontré que l’amplitude et la durée des impulsions que reçoit la synapse artificielle provoquent une variation de la résistance du matériau, donc de sa capacité à transmettre le courant tunnel. Cette propriété est très similaire à la plasticité des synapses biologiques », détaille le chercheur.

« De nombreux matériaux peuvent, sur application de certaines gammes de tensions, présenter ce type de propriétés de changement de résistivité », remarque Vincent Derycke, chercheur au sein du laboratoire Nimbe7. Oxydes de métal, matériaux spintroniques, ferroélectriques…, la palette de candidats « exotiques » (c’est-à-dire marginaux par rapport à ceux utilisés en microélectronique classique, fondée sur le silicium) est en effet très large. « Toute la question est : leurs changements de résistivité sont-ils exploitables pour bâtir des circuits efficaces ? Jusqu’ici, aucun matériau idéal ne s’est encore détaché ».

Avec son équipe, il s’est spécialisé dans une voie originale : l’électronique organique, qui vise à traiter l’information au sein de molécules (assemblages de quelques atomes seulement), et ainsi réduire encore les consommations énergétiques. « C’est comme cela que l’industrie a pu remplacer les LED par des équivalents organiques, les OLED, dans de nouvelles générations d’écrans plats », explique le chercheur. Ce dernier ne cache pas le côté exploratoire de cette piste : « Mis à part les OLED, l’électronique organique, qui promettait au début des années 2000 de révolutionner l’électronique, n’a pas tenu toutes ses promesses et demeure un domaine de recherche principalement fondamental. Si d’éventuels neurones ou synapses organiques, très économes en énergie, deviennent réalité, ce ne sera pas avant cinq ou dix ans ».

Le défi des circuits intégrés

Malgré une multitude de matériaux proposés pour l’ingénierie neuromorphique, tous les chercheurs butent pour l’instant sur le même obstacle : le passage à l’échelle. « Un composant seul peut présenter un comportement physique remarquable, mais ce bénéfice s’estompe parfois lorsque l’on en intègre des milliers », commente Damien Querlioz. Il suffit par exemple que la tension électrique arrivant à l’entrée de chaque composant varie légèrement pour ruiner l’intérêt d’une puce neuromorphique complexe. Or, « des milliers, voire des centaines de milliers de composants à intégrer ensemble, c’est pourtant le minimum si l’on veut mettre au point de premières applications commerciales », poursuit le jeune chercheur, médaille de bronze du CNRS en 2017 pour ses travaux sur ces futures architectures neuromorphiques.

Le contrôle fin de la tension d’entrée donne encore du fil à retordre aux chercheurs. C’est l’un des défis que se propose de relever l’équipe de Sylvain Saighi au sein du Laboratoire de l’intégration du matériau au système8. À partir de la synapse ferroélectrique de Vincent Garcia, dite « memristorFermer contraction de « memory » et « resistor »», les chercheurs tentent de construire un circuit de 1024 x 100 éléments. À travers le projet européen Ulpec, impliquant notamment IBM, Bosch et la société parisienne Chronocam, ce circuit devrait ensuite être intégré et testé au sein d’une caméra embarquée dans la voiture autonome. Restera aussi à régler le problème de la production en série des composants : « Il nous faut maintenant montrer que l’on peut produire notre memristor sur les substrats silicium habituels des industriels de la microélectronique pour envisager une production à grande échelle », prévoit Sylvain Saïghi. Même ambition pour Julie Grollier. D’ailleurs, si son équipe a été la première à faire fonctionner des neurones artificiels bio-inspirés au sein d’une application, c’est parce qu’elle a usé d’un astucieux artifice : un seul nano-neurone a permis de reconstituer un circuit de 400 neurones grâce à la méthode de multiplexage temporel. « Un peu comme si un acteur s’enregistrait en train de jouer les 400 rôles d’un même film et qu’on les superposait au montage », illustre la chercheuse. Les circuits bien réels de centaines ou de milliers de neurones sont donc aujourd’hui attendus de pied ferme ! ♦

Lire aussi : « Des machines enfin intelligentes ? »

- 1. « Neuromorphic computing with nanoscale spintronic oscillators », J. Torrejon et al., Nature, 2017, vol. 547 : 428-431 (publié en ligne le 27 juillet 2017). https://www.nature.com/articles/nature23011

- 2. Unité CNRS/Thales/Université Paris-Sud.

- 3. « Learning through ferroelectric domain dynamics in solid-state synapses », S. Boyn et al., Nature Communications, 2017, vol. 8, publié en ligne le 3 avril 2017. https://www.nature.com/articles/ncomms14736

- 4. Unité CNRS/Université Paris-Sud/Université Paris-Saclay.

- 5. Unité CNRS/Université de Lille 1.

- 6. Unité CNRS/Université de Nantes.

- 7. Nanosciences et innovation pour les matériaux, la biomédecine et l’énergie (CNRS/ CEA/Université Paris-Saclay).

- 8. Unité CNRS/Bordeaux INP/Université de Bordeaux.