Vous êtes ici

Europe : des réseaux sociaux sous influence

Dans le cadre de vos recherches, vous étudiez les algorithmes des plateformes en ligne, leur impact sur la société, et notamment sur les élections. Comment procédez-vous ?

Paul Bouchaud1. À l'Institut des systèmes complexes de Paris Île-de-France, je collabore régulièrement avec AI Forensics, une organisation européenne à but non lucratif qui enquête sur des algorithmes influents et opaques de YouTube, Google, TikTok, Amazon ou du groupe Meta, qui détient les réseaux Facebook, Instagram et WhatsApp. Nous menons, avec une équipe de « détectives numériques » dont je fais partie (experts en informatique, droit, éthique, sociologie, psychologie et communication), des enquêtes techniques indépendantes, pour mettre en évidence les dommages causés par les algorithmes de ces plateformes. Nous nous concentrons sur la surveillance des élections en raison de l’impact immédiat sur la démocratie et les droits fondamentaux, et nous médiatisons ensuite ces enquêtes afin de promouvoir la transparence et la responsabilité dans le domaine des algorithmes influents.

C’est avec les élections américaines de 2016 que l’on a pris conscience des risques de manipulation via les réseaux sociaux…

P. B. En effet, il a fallu de longues enquêtes, parlementaires et judiciaires, pour lever le voile sur l’offensive de propagande du Kremlin lors de ces élections qui ont vu l’accession au pouvoir de Donald Trump. En 2018, l’acte d’accusation du procureur américain Robert Mueller montrait que 126 millions de personnes sur Facebook et 1,4 million sur Twitter avaient été exposées, à coup de faux profils et de publicités ciblées, à des messages visant à diviser la société américaine.

Certaines pratiques et procédures de contrôles ont depuis été ajustées, mais cela reste largement insuffisant, et le scénario de 2016 risque fort de se reproduire. La législation américaine reste bien moins contraignante que celle adoptée par l’Union européenne (UE), qui, si elle était vraiment appliquée, permettrait de lutter contre la désinformation, comme ma recherche2 le démontre aujourd’hui…

Cette nouvelle réglementation européenne permet-elle de vérifier si les règles régissant la mise en ligne d’éléments de propagande politique sont observées ou non par le groupe Meta ?

P. B. Oui, le Digital Services Act (DSA), qui est entré en application le 25 août 2023, vise à limiter la diffusion en ligne de contenus haineux, pédopornographiques, terroristes, et la diffusion de produits illicites (contrefaits ou dangereux). Il ne remet pas en cause la responsabilité limitée des plateformes vis-à-vis des contenus et produits illicites qu’elles hébergent (notion d’hébergeur « passif »). Elles doivent en revanche proposer un outil permettant aux utilisateurs de les signaler, et rend pour cela public l’accès aux bibliothèques publicitaires d’une vingtaine de plateformes3.

Techniquement, j’ai donc, dès août 2023, entraîné sur 14 langues européennes un algorithme que j’ai développé à partir de tous les exemples de publicités rendus disponibles par le groupe Meta sur ses réseaux Facebook et Instagram. Cet algorithme permet de détecter quelles publicités sont de nature politique ou pas, et si oui, si elles ont été identifiés comme telles par Meta. Si la publicité est déclarée comme politique, des informations supplémentaires sont rendues publiques, sur qui a payé la publicité, l’audience ciblée (âge, genre, localisation), et l’audience atteinte (mêmes informations).

Quelle part de contrôle Meta exerce-t-elle sur le contenu des publicités ainsi mises en ligne ?

P. B. Les publicités se définissent comme des messages dont la diffusion sur Meta (ou sur d’autres plateformes) fait l’objet d’une rémunération, que leur contenu soit commercial ou non. C’est ainsi qu’un groupe, un individu, peut rétribuer Meta pour qu’elle diffuse à un public plus ou moins large, plus ou moins ciblé, un message destiné à vendre par exemple plus de chaussettes ou à voter pour tel parti. Sachant qu’une même publicité peut être postée sur plusieurs réseaux (Instagram et Facebook par exemple) en même temps. Seul garde-fou : si la publicité est d’ordre politique, l’annonceur doit cocher la case « ma publicité est à caractère politique », ce qui oblige Meta à vérifier le contenu de cette publication avant de l’approuver, ou non.

J’ai passé au crible 30 millions de publicités publiées en janvier et février 2024 dans 16 pays européens : environ 98 % d’entre-elles sont à caractère commercial, mais sur les 2 % restants (environ 600 000), 95 % ne sont pas repérées par Meta comme délivrant un message politique. Cela peut paraître peu, mais cela représente, pour la France par exemple, 200 publicités par jour, et pour les 16 pays de l’Union européenne 1 300 publicités par jour, sachant que certaines proviennent clairement de campagnes de propagande coordonnées et sont vues par des millions de personnes.

Et vous avez aussi mis au jour un important réseau de propagande prorusse ?

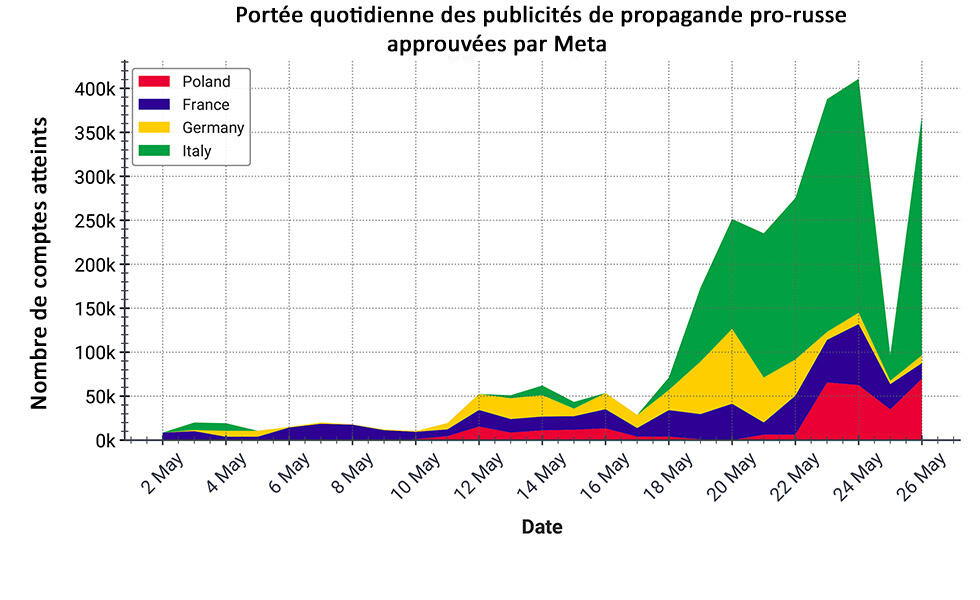

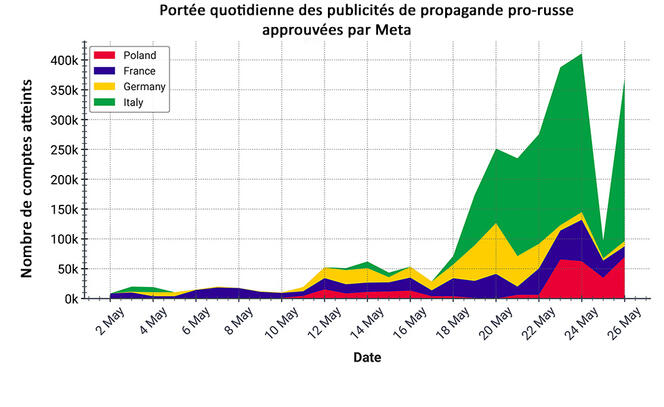

P. B. Sur sept mois, entre août 2023 et mars 2024, la propagande prorusse, qui a pour but de saper le soutien des gouvernements européens et de l’Union européenne à l’Ukraine, a atteint 38 millions de comptes en France et en Allemagne. Parmi les 3 826 pages Facebook impliquées, moins de 20 % ont été modérées par Meta, alors qu’elles avaient déjà été montrées à des utilisateurs au moins 2,6 millions de fois. À l’approche des élections, ces actions de propagande s’intensifient. Entre le 1er et le 27 mai 2024, Meta a laissé au moins 275 messages de propagande prorusse atteindre 3 millions de comptes français, allemands, italiens et polonais. De plus, ces messages ciblent maintenant massivement l’Italie et la Pologne, comme le prouvent nos derniers relevés (cf schéma ci-dessous).

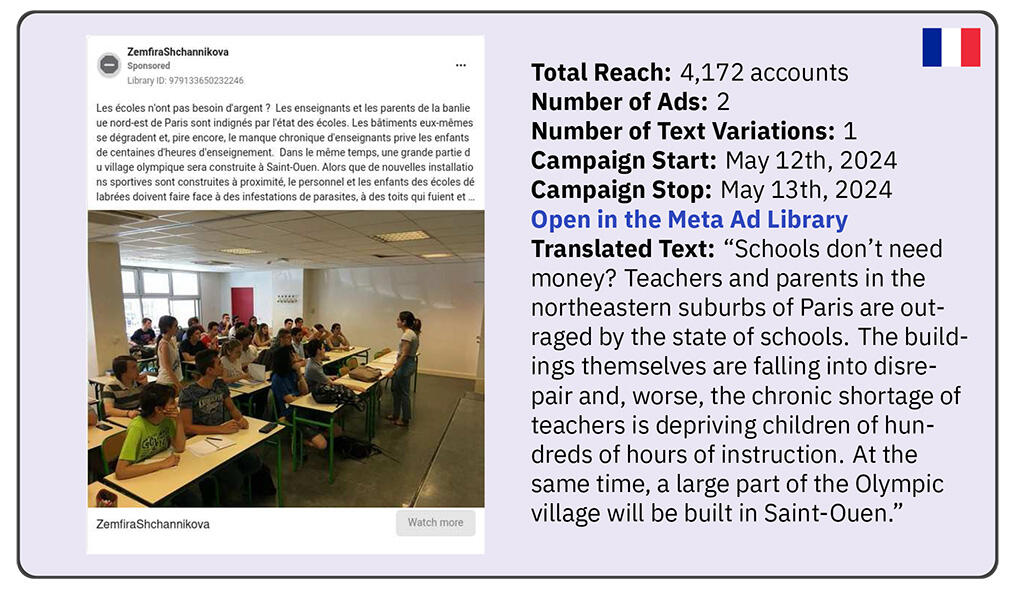

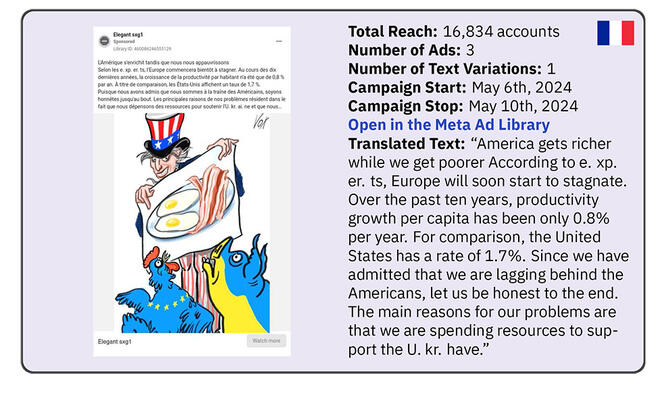

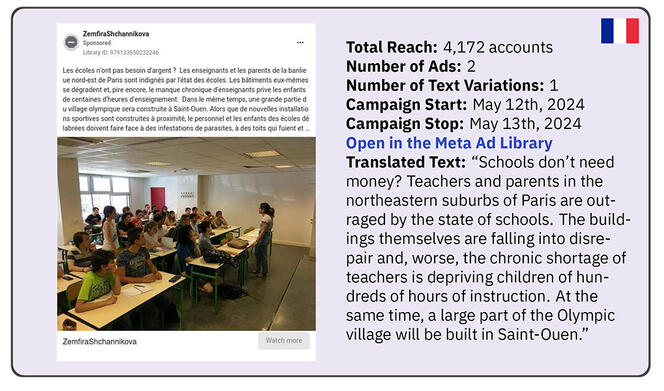

Concrètement, comment ces publicités se présentent-elles ?

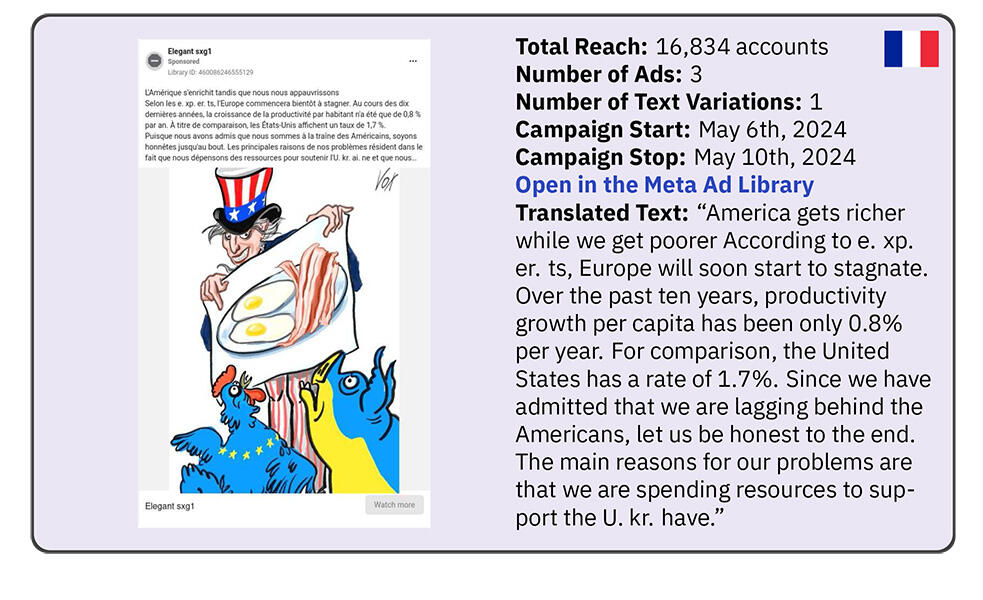

P. B. Elles se présentent sous la forme de textes, souvent illustrés par des caricatures, qui reprennent un élément de l’actualité pour ridiculiser un gouvernement, cibler l’incurie d’un État, ou dénoncer une mesure gouvernementale. Par exemple, pour les messages ciblant la France, le président Macron, caricaturé comme incapable de sécuriser un petit territoire comme la Nouvelle-Calédonie, serait incapable de défendre l’Ukraine. Autre exemple : si l’Amérique s’enrichit alors que l’Europe s’appauvrit, c’est parce que l’Union dépense ses ressources pour soutenir l’Ukraine. Dans ce dernier message étaient inclus les taux de croissance de la productivité par habitant sur les deux continents, ce qui contribue à le crédibiliser comme provenant d’une source « sérieuse ». Et de nombreux messages sont conçus de la sorte, ce qui permet de tromper facilement les individus ciblés.

Les auteurs de ces publicités s’identifient-ils ?

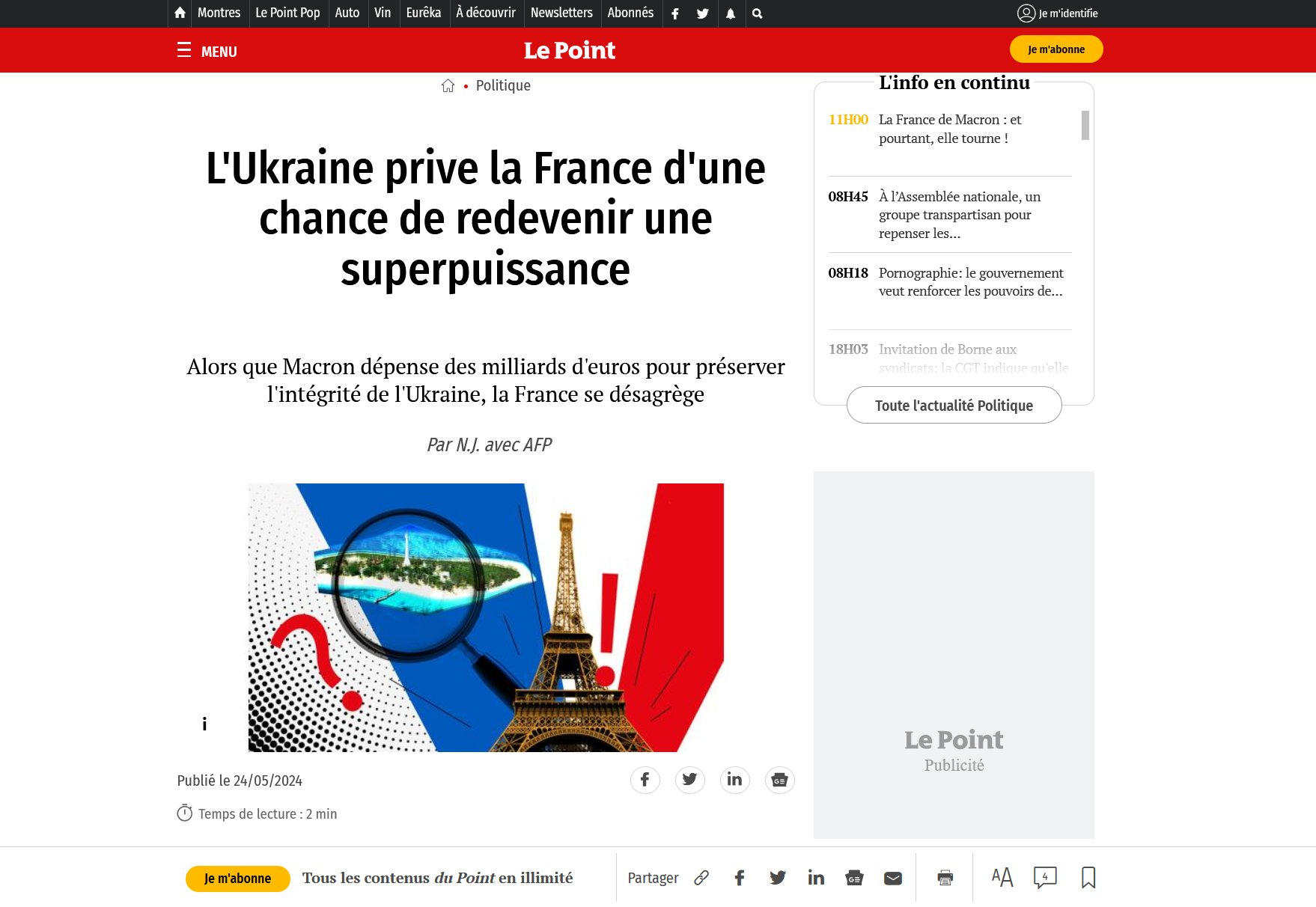

P. B. Les noms qui apparaissent en haut de ces messages (« tempnafor », « Awudud online shop », etc), sont générés automatiquement par les annonceurs et ne correspondent à rien. En fait, les internautes ne les regardent quasiment pas. Ces derniers jours est apparue ainsi une publicité usurpant l’identité graphique de l’hebdomadaire Le Point, difficile à distinguer d’un véritable article. Quant aux auteurs, ils sont rarement identifiés.

Un réseau particulièrement influent a cependant été mis à jour, c’est le réseau prorusse Doppelgänger. Depuis le début de la guerre en Ukraine, il diffuse de fausses informations sur le conflit à travers des copies réalistes de pages de ministères de pays européens, et en faisant circuler des articles du « média » Reliable Recent News (« nouvelles récentes et fiables », RRN) qui publie quotidiennement des articles de désinformation dans plusieurs langues, dont le français. En juillet 2023, l’UE a pris des sanctions4 contre deux entreprises (Social Design Agency et Structura National Technologies), suspectées d’avoir joué un rôle clé dans la circulation de ces articles. Mais ce réseau continue d’agir, et tente désormais d'instrumentaliser le conflit entre Israël et le Hamas de la même façon.

Votre algorithme a-t-il été compliqué à développer ?

P. B. Cela m’a pris un mois, et je l’ai développé seul, sans l’aide d’aucune équipe. Donc si une entreprise de la taille de Meta ne parvient pas à détecter rapidement les campagnes publicitaires politiques masquées, c’est tout simplement qu’elle n’en n’a pas la volonté. Bien sûr, le contrôle est plus difficile à faire dans les pays où le nombre de modérateurs est faible, et selon les chiffres fournis par Meta (cf shéma), il peut être compliqué pour trois Estoniens de vérifier tous les messages publiés sur les réseaux de ce territoire ! Mais la France et l’Allemagne par exemple, avec plus de deux cents modérateurs, sont mieux dotés.

Surtout, comme nos recherches le prouvent, les outils informatiques, sont assez efficaces. Mais Meta ne transmet pas d’information sur la façon dont elle modère ces publicités, elle se contente de dire qu’elle utilise pour partie des outils informatiques, pour partie des humains, parce qu’elle en a l’obligation.

En tant qu’individu, puis-je poster n’importe quel contenu ?

P. B. Tout message haineux ou véhiculant une fausse information peut être supprimé. La détection automatique de contenus haineux est plutôt bien effectuée. En revanche, quand il s’agit de désinformation politique, à moins que votre message ne devienne viral, il a peu de chance d’être repéré par Meta. Il faut que quelqu’un le signale.

Quels sont les moyens de pression sur Meta pour que le contrôle soit effectué ?

P. B. Cette enquête constitue un défi direct pour les efforts de l’UE visant à garantir des élections équitables et transparentes. L’utilisation abusive continue des plateformes numériques à des fins politiques souligne la nécessité d’une surveillance stricte et de mesures proactives de la part des organismes de réglementation et des plateformes elles-mêmes. J’ai informé la Commission européenne, qui a annoncé le 30 avril l’ouverture d’une procédure formelle contre Meta pour des manquements présumés au DSA. La plateforme est donc censée prendre des mesures pour éviter que son système de publicités puisse être utilisé à des fins de propagande. Mais cette procédure n’est pas bornée par un délai particulier. Si le différend persiste, la Commission peut prendre des sanctions allant jusqu’à une amende de 6 % du chiffre d’affaires mondial de la plateforme.

Dans le passé, on a pu constater à quel point les algorithmes en ligne pouvaient avoir une influence sur ce qui se passe hors ligne, jusqu’à entrainer des attaques contre une population entière…

P. B. Une enquête à laquelle je n’ai pas participé mais qui a été réalisée par Amnesty International5 a montré comment le système algorithmique de Facebook a promu la haine contre les Rohingyas, contribuant ainsi aux atrocités commises par l’armée du Myanmar en 2017. Certains acteurs, cherchant à déshumaniser les Rohingyas, ont posté des messages violents ayant pour conséquence de désinhiber les militaires chargés du nettoyage ethnique et des viols de masse. En choisissant quels messages afficher dans le fil de chaque utilisateur, Meta met en avant les contenus qui font beaucoup réagir, que ces réactions soient positives ou négatives – ce qui est le propre des contenus haineux. Facebook leur a offert une audience sans précédent en Birmanie. Plusieurs groupes de Rohingyas ont lancé des procès contre Meta. Mais le mal est fait. Seule une régulation étatique pourrait permettre d’éviter de telles situations. ♦

Source

"On Meta's Political Ad Policy Enforcement: An analysis of Coordinated Campaigns & Pro-Russian Propaganda", Paul Bouchaud, 2024. ⟨hal-04541571v1⟩

À lire sur notre site

Fake news : oui, les adolescents peuvent se défendre

Internet, l'autoroute de la désinformation

Réseaux sociaux, les rouages de la manipulation de l'opinion

La présidentielle 2017 au prisme de Twitter

- 1. Spécialiste en audit algorithmique, doctorant à l’Institut des systèmes complexes de Paris île de France (CNRS).

- 2. On Meta's Political Ad Policy Enforcement: An analysis of Coordinated Campaigns & Pro-Russian Propaganda - Archive ouverte HAL

- 3. Dans le cadre du DSA, la Commission européenne a désigné une vingtaine de grandes plateformes concernées comme Alibaba, Amazon Store, Apple AppStore, Booking.com, Facebook, Google Play, Google Shopping, Instagram, LinkedIn, Pinterest, Snapchat, TikTok, X (ex-Twitter), Wikipédia, YouTube, Zalando, etc. et deux grands moteurs de recherche en ligne, Bing et Google Search.

- 4. Actifs gelés et interdiction d’entrée sur le territoire des membres de cette entreprise.

- 5. « The Social Atrocity », rapport Amnesty international, septembre 2022.

Voir aussi

Auteur

Journaliste en presse écrite, spécialisée des sujets sciences, société et éducation (pour Le Monde, Science et Vie, Eurêka, etc.), Marina Julienne a aussi réalisé plusieurs documentaires pour France Télévision et Arte. À la rédaction de CNRS Le Journal depuis 2023, elle suit plus particulièrement...