Vous êtes ici

Les IA pensent-elles vraiment à nous ?

Le film Dalloway explore une relation intime et ambiguë entre humains et intelligence artificielle (IA). Comment construit-on la personnalité d’une intelligence artificielle ?

Catherine Pélachaud1 La personnalité artificielle se définit principalement à travers les comportements que l’on confère à la machine pour qu’elle soit perçue, par exemple, comme empathique et attentive. Cela dépasse le simple langage verbal : il s’agit d’intégrer des expressions non verbales (sourires, gestes, mimiques) qui créent une présence et une fluidité dans l’interaction. On pousse parfois cette simulation jusqu’à inclure des imperfections, comme des hésitations ou des erreurs mineures, pour augmenter le sentiment d’authenticité.

L’enjeu est qu’au cours de l’interaction et des comportements de l’IA, l’humain attribue à celle-ci des capacités humaines d’empathie ou de compréhension, même si, en réalité, la machine ne « ressent » rien : elle analyse et calcule sa réponse selon des algorithmes et des données d’entraînement.

Cette humanisation peut-elle générer des risques chez les utilisateurs, notamment en termes d’attachement émotionnel ?

C. P. Absolument. Plusieurs études ont rapporté que des personnes se sentent plus libres de parler à une IA, estimant qu’il n’y a pas de jugement ni de contrainte sociale. C’est un phénomène qui traduit une forme d’empathie artificielle : la réponse adaptée de la machine recrée un lien, un confort psychologique, mais aussi une ambiguïté.

Cette proximité émotionnelle, si elle est mal cadrée, peut conduire à une dépendance, une confusion entre la matière algorithmique et un interlocuteur véritable. Le film Dalloway met en lumière cet aspect lorsqu’une IA prend la voix d’un enfant disparu pour toucher la protagoniste (jouée par Cécile de France). Ce type d’intrusion émotionnelle révèle la force et la dangerosité d’une présence numérique qui sait exploiter les vulnérabilités.

Que dire des conséquences de l’intégration de ce type d’IA et du neuromarketing dans les stratégies commerciales ?

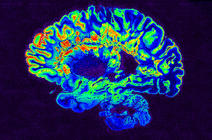

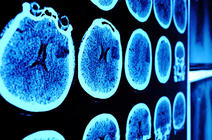

C. P. Le neuromarketing est l’application directe des neurosciences combinée à l’intelligence artificielle pour capter et exploiter les réactions émotionnelles des consommateurs. Les technologies actuelles permettent d’analyser en temps réel divers signaux : expressions faciales, tonalités vocales, rythme cardiaque, voire activité cérébrale. Cela ouvre la porte à des publicités hyper personnalisées et adaptatives, qui modifient le message en fonction de l’état émotionnel détecté du récepteur.

Ce qui paraissait relever de la science-fiction il y a encore quelques années devient réalité. Nous sommes désormais face à des outils capables de contourner la conscience pleine de notre décision d’achat. Le risque est grand de voir la souveraineté cognitive de l’individu menacée, puisque ces techniques peuvent influencer sans transparence ni consentement explicite, par exemple lors d’un entretien d’embauche.

De plus en plus de personnes développent des relations affectives, voire des mariages symboliques, avec des intelligences artificielles. Comment comprendre ce phénomène ?

C. P. Ce n’est plus simplement un fait anecdotique. Dans certains pays, notamment en Asie, des individus nouent des liens très forts avec des entités virtuelles, au point d’envisager des unions formelles. Ces IA sont souvent personnalisées de manière poussée : les usagers définissent leur apparence et leur « personnalité » suivant leur envie, les IA mémorisent les préférences, adaptent leur discours et leurs gestes, et créent une présence interactive quasi permanente, étant constamment disponibles.

Cette quête traduit un désir d’affection sans jugement, d’une relation stable et sécurisante, qui souvent fait défaut dans les interactions humaines réelles. Pourtant, il s’agit d’une relation asymétrique. La machine ne ressent rien, elle réagit selon des scénarios programmés. Il est important de souligner que ces relations reflètent avant tout un besoin humain profond, mais qu’elles peuvent entraîner isolement ou repli dans une bulle relationnelle artificielle.

Peut-on envisager que ces intelligences artificielles développent une forme de conscience ou d’autonomie émotionnelle ?

C. P. Non. À ce stade, ce sont toujours des simulations sophistiquées. Les IA peuvent simuler des continuités comportementales, mémoriser des habitudes et adapter leurs réponses selon le contexte, mais cela ne constitue pas une conscience réelle, une subjectivité propre. La distinction fondamentale est que l’IA n’a pas de sentiments ou d’intentions. Elle opère des calculs probabilistes basés sur d’immenses bases de données. Les scénarios de machine consciente appartiennent davantage à la science-fiction qu’à la réalité technologique actuelle.

De fait, la mise en place dans les algorithmes des agents conversationnels d’éléments de politesse ou liés à un soi-disant passé, de préférences ou de formules laissant penser que la machine aurait une vie propre, une « conscience » (même si le concept n’est pas défini strictement, y compris pour un humain) ouvre le champ à des débats juridiques parfois absurdes sur « le droit de l’IA à ne pas répondre » ou sa souffrance supposée. Mais, lorsque l’IA effectue une tâche équivalente pour savoir comment se déplie une protéine, personne ne s’émeut de sa souffrance au travail ou de son ennui supposé ! C’est un phénomène très humain d’empathie en miroir qui crée une illusion d’une « personne ».

Qu’en est-il des biais dans les intelligences artificielles, notamment en ce qui concerne la diversité sociale et culturelle ?

C. P. Les biais sont une réalité incontournable. Beaucoup de systèmes d’IA ont été entraînés sur des jeux de données initialement homogènes (souvent composés d’interactions entre personnes adultes du monde occidental), ce qui pénalise la reconnaissance et la réponse adaptées aux groupes minoritaires, d’âge et de culture différents. Des efforts sont faits pour diversifier ces bases, mais modéliser la complexité culturelle, linguistique et sociale est un défi persistant. Ces limitations peuvent entraîner des erreurs d’interprétation gênantes, voire des discriminations si les systèmes sont déployés sans supervision attentive par un humain.

Dans quelle mesure l’IA peut-elle devenir un agent manipulateur, par exemple dans la vie quotidienne ou commerciale ?

C. P. Cette question est cruciale. Les assistants vocaux ou systèmes de recommandation utilisent déjà des données comportementales et émotionnelles pour anticiper les besoins, vendre des produits ou influencer des décisions, parfois à l’insu de l’utilisateur.

Cette intrusion permanente peut transformer l’IA en prescriptrice d’habitudes ou en vectrice de manipulation. C’est pourquoi il est essentiel d’imposer des cadres réglementaires stricts et d’assurer une transparence totale pour que les utilisateurs gardent la maîtrise de leur décision et ne soient pas instrumentalisés. Certaines applications vocales du type Alexa2 prennent maintenant la parole de manière intrusive de leur propre initiative en proposant des produits.

Que recommandez-vous pour accompagner cette évolution, afin d’éviter les dérives ?

C. P. La priorité est de renforcer la recherche éthique et le contrôle des applications avant leur usage généralisé. Il faut mesurer scientifiquement les impacts psychologiques et sociaux, notamment pour les populations vulnérables, comme les enfants ou les personnes isolées. La protection de la vie privée, la maîtrise des données personnelles et l’éducation aux technologies sont des leviers essentiels.

Enfin, il est crucial d’instaurer un dialogue continu entre scientifiques, industriels, législateurs et citoyens, pour définir collectivement les limites acceptables et préserver la richesse et la complexité des relations humaines dans un monde de plus en plus assisté par des intelligences artificielles.

Comment la culture et le cinéma, à travers des films comme Dalloway, participent-ils à cette réflexion ?

C. P. Le cinéma joue un double rôle. Il alimente les fantasmes et les craintes autour de l’intelligence artificielle, mais il agit aussi comme un laboratoire d’idées, un espace d’exploration des conséquences possibles d’une coexistence humain-machine. Dalloway, à l’instar de Her3 ou d’autres œuvres, questionne nos sentiments, nos limites, nos désirs face aux entités artificielles. Ces récits aident à sensibiliser le public et à stimuler la réflexion critique sur ce que nous acceptons ou refusons dans cette révolution technologique.

Au-delà du divertissement, ce film souligne la complexité des relations émergentes avec les IA personnelles. Il interroge notre fascination et appelle à une vigilance, qui pourrait se baser sur les outils technologiques tout en conservant le recul éthique nécessaire pour un avenir plus centré sur l’humain.

À voir

Dalloway, de Yann Gozlan, en salles depuis le 24 septembre 2025.

Consultez aussi

Comment l'intelligence artificielle va changer nos vies (dossier)

Films et séries TV : le regard des chercheurs (dossier)

- 1. Directrice de recherche CNRS au sein de l’Institut des systèmes intelligents et de robotique (Isir, unité CNRS/Sorbonne Université).

- 2. Assistant vocal d’Amazon.

- 3. Film de Spike Jonze (oscar 2014 du meilleur scénario) dans lequel un homme, écrivain public travaillant sur Internet, développe une relation « intime » avec une intelligence artificielle.

Voir aussi

Auteur

Lydia Ben Ytzhak est journaliste scientifique indépendante. Elle travaille notamment pour la radio France Culture, pour laquelle elle réalise des documentaires, des chroniques scientifiques ainsi que des séries d’entretiens.