Vous êtes ici

Données numériques: une jungle à défricher

Temps de lecture : 6 minutes

Aujourd’hui, si les chiffres correspondant aux informations numériques disponibles ont de quoi donner le tournis, ils soulèvent aussi une question essentielle : celle de la difficile analyse de ces masses de données considérables et en perpétuelle expansion. Professeur d’informatique et membre du Laboratoire d’informatique de Grenoble (LIG)1, Marie-Christine Rousset appartient à cette communauté de scientifiques qui tente de structurer le flot ininterrompu de données circulant sur la Toile : « Les pages que nous consultons tous les jours appartiennent au Web textuel qui regroupe des milliards de documents reliés entre eux, explique-t-elle. Pour autant, ces pages ne peuvent pas être exploitées comme une véritable base de connaissances, car elles ont été conçues pour être lisibles par des êtres humains et non par des machines. » Autrement dit, un moteur de recherche comme Google, dans lequel nous formulons une requête, se contente de proposer une liste de milliers de documents correspondant à cette demande. Il laisse ensuite à l’usager le fastidieux travail d’investigation destiné à identifier la réponse la plus pertinente à sa requête.

L’évolution vers un Web des données

Or, face à l’accroissement vertigineux des documents disponibles sur le Net, de tels modèles risquent d’être rapidement submergés par le flot d’informations à gérer. Quelle est l’alternative ? Faire évoluer le réseau actuel vers un Web des données : « Cette approche se fonde sur l’association de métadonnées aux adresses URL qui identifient les pages Web. Elle vise à casser la complexité du Web actuel en structurant l’information sur Internet de manière à pouvoir accéder plus simplement à la connaissance », résume Marie-Christine Rousset.

Cette évolution est déjà en marche au travers du W3C, le consortium international qui veille au respect des normes sur le Web. Certains embryons de ce Web, qualifié de sémantique car il permet aux machines de comprendre la signification de l’information circulant sur la Toile, existent déjà. Mais faire du Web sémantique un modèle universel reste une tâche ardue. « Greffer des algorithmes d’interrogation sur une base de données centralisée est une chose, commente la scientifique du LIG, mais y parvenir à l’échelle de cette gigantesque entité décentralisée qu’est le Web ne relève pas d’un simple problème d’amélioration technologique ! »

Comment fédérer et exploiter les données

Ces dernières années, un domaine scientifique a vu ses pratiques complètement bouleversées par les avancées technologiques : la recherche biomédicale. « Le volume d’information provenant de l’imagerie biomédicale s’est considérablement accru avec le passage au tout-numérique au cours des dix dernières années », témoigne Johan Montagnat, directeur de recherche CNRS au laboratoire Informatique, signaux systèmes de Sophia Antipolis (I3S)2 et coordonnateur, dans le cadre de Mastodons, du projet Credible, destiné à fédérer les données et les connaissances en imagerie biomédicale éparpillées au sein de plusieurs établissements hospitaliers sur le territoire français. « La stratégie consistant à centraliser des masses de données médicales sera tôt ou tard limitée par les capacités de stockage disponible, signale Johan Montagnat. De plus, la multiplication des instruments d’acquisition de données au sein des établissements hospitaliers rend inévitable la distribution de celles-ci sur différents sites de stockage. »

noyade dans

l’océan numérique

des grandes

masses de données,

il faut recourir à

des spécialistes en fouilles de données.

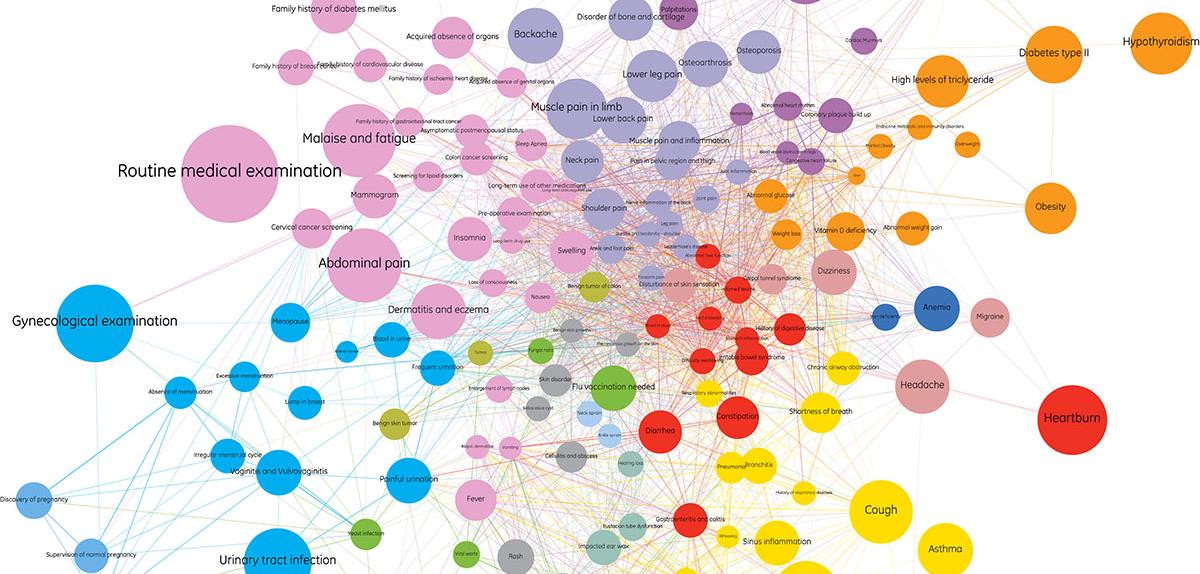

Mais cette logique fédérative se heurte à des difficultés techniques. En effet, il s’agit de faire converger deux types de données : des données brutes (images, résultats de traitements…) et des données dites symboliques, provenant de la description des premières : contexte d’acquisition des données brutes, caractéristiques anatomiques ou pathologiques extraites d’une image, etc. « L’un des principaux défis du projet Credible consiste à mettre au point une représentation sémantique de ces données symboliques dans le but de leur attribuer une signification scientifique », poursuit le chercheur. Ainsi harmonisées, ces bases de données, d’ordinaire très hétérogènes, pourraient alors être regroupées dans une même étude clinique, d’envergure nationale voire internationale. L’analyse, à une telle échelle, des ressources biomédicales fournirait aux chercheurs un moyen inédit pour répondre aux défis de santé auxquels ils se heurtent encore aujourd’hui.

Pour éviter la noyade dans l’océan numérique des grandes masses de données, il faut recourir à des experts : les spécialistes en fouilles de données. Partant des bases de données à l’état brut, ils sont chargés de faire remonter à la surface les connaissances qu’elles renferment. « Ce travail algorithmiquement difficile revient à parcourir un damier constitué de millions de lignes et de colonnes pour y repérer une poignée de motifs répétés », explique Jean-François Boulicaut, chercheur du Laboratoire d’informatique en images et systèmes d’information (Liris)3 de Villeurbanne.

Des données convoitées par les entreprises

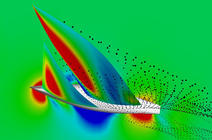

Avec son équipe, cet expert met à contribution son savoir-faire dans le cadre du projet Mastodons sur l’analyse de masse de données de l’urbain et de l’environnement (projet Amadouer). Il s’agit ici d’explorer les bases de données de l’agglomération lyonnaise pour y recueillir les informations sur la pollution environnementale et le flux de circulation automobile. Le traitement de ces données doit aider à élaborer une nouvelle politique des transports en centre-ville. À l’aide de simulations mathématiques, l’objectif est de concevoir un modèle dans lequel la voiture n’aurait plus qu’une place limitée.

Revers de la médaille : ce type de données intéresse de très près certains groupes industriels qui souhaitent se les approprier à des fins commerciales, parfois au détriment de la communauté scientifique. « Il y a une vingtaine d’années, une société a voulu racheter les droits sur les photos numériques détenues par les musées de France, rappelle Jean-François Boulicaut. Or, comme la qualité du procédé était à l’époque loin d’égaler celle de l’argentique, le ministère de la Culture avait failli signer cet accord, avant de faire machine arrière. » Espérons que les décideurs politiques sauront faire preuve de la même clairvoyance dans l’eldorado de la recherche sur des grandes masses de données.

Voir aussi

Auteur

Grégory Fléchet est né à Saint-Étienne en 1979. Après des études de biologie suivies d’un master de journalisme scientifique, il s’intéresse plus particulièrement aux questions d’écologie, d’environnement et de santé.