Vous êtes ici

Des voitures autonomes sans frontières ?

Dans le domaine du véhicule autonome, il y a un monde entre le circuit et la circulation urbaine. Il ne suffit pas de respecter le Code de la route, encore faut-il composer avec les usagers et leurs habitudes. Google en sait quelque chose : le 14 février, en Californie, l’une de ses voitures s’est heurtée à la règle implicite qu’un bus ne s’arrête pas forcément pour laisser passer un véhicule de particulier.

Comprendre son environnement et réagir de manière adéquate, c’est tout l’enjeu du projet Pretiv (Perception multimodale et compréhension de scène pour des véhicules intelligents et transnationaux) soutenu par l’Agence nationale de la recherche. Celui-ci réunit depuis 2011 le laboratoire Heudiasyc (Heuristique et diagnostic des systèmes complexes)1, le laboratoire KLMP de l’université de Pékin, Inria, à Grenoble et le Groupe PSA.

Comprendre son environnement

Grâce au partenariat avec la Chine, les chercheurs ont pu appréhender une variété de situations jusqu’alors inconnues en France : « En Chine, l’environnement de conduite est relativement fluide, explique Franck Davoine, chargé de recherche au laboratoire Heudiasyc et coordonnateur du projet Pretiv. Voitures et piétons cohabitent dans les carrefours. On rencontre aussi d’importantes différences au niveau de l’infrastructure et des objets qui composent les scènes, comme des tricycles surchargés. »

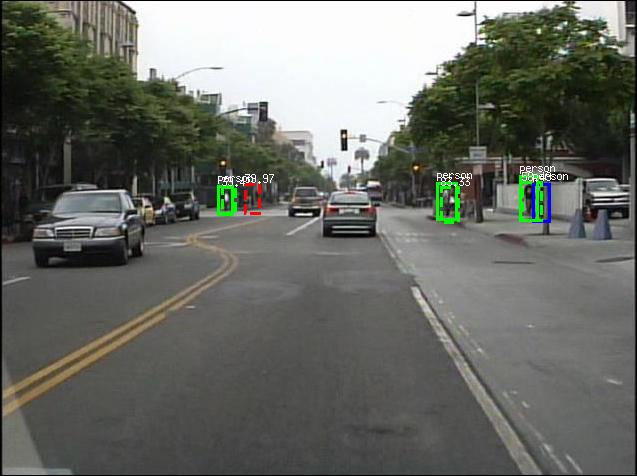

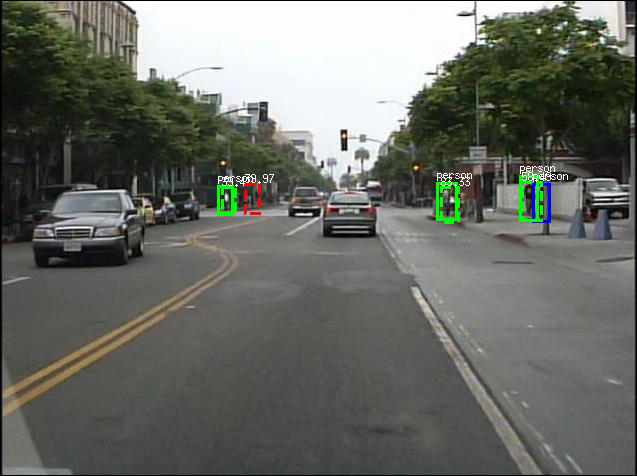

Un des nombreux défis à surmonter consiste à réduire les erreurs de détection, dont le taux est encore trop élevé pour répondre aux règles imposées par les constructeurs. Pour ne rien arranger, le comportement d’un piéton chinois diffère de celui d’un piéton français et un tricycle surchargé de paquets n’a ni le même aspect ni le même comportement qu’un Vélib’ surgissant d’un trottoir.

à nos algorithmes

l’apparence

des piétons ainsi

que leurs comportements

sur la route.

Mais les difficultés ne s’arrêtent pas là. Si l’apprentissage devient plus performant au gré des répétitions d’un même trajet, un changement trop important dans l’environnement chamboule le système qui perd alors ses repères. C’est le cas des paysages soumis aux variations saisonnières tels que des zones urbaines végétalisées. À terme, les ordinateurs de bord des voitures autonomes seront certainement dotés d’une base comportementale en plus du Code de la route local, ainsi que de cartes tenant compte de l’aspect des routes, des infrastructures et des réseaux urbains en fonction des pays et… des saisons.

L’université de Karlsruhe en Allemagne et Caltech en Californie mettent d’ores et déjà à disposition leurs propres bases de données d’analyse de scènes urbaines. « Cela nous permet d’apprendre à nos algorithmes l’apparence des piétons ainsi que leurs comportements sur la route », se réjouit Franck Davoine. Mais ces données restent spécifiques à leurs pays et demandent à être complétées au niveau mondial. C’est pourquoi « nous nous orientons vers des solutions de reprise en main par le conducteur ou un téléopérateur en cas de problème », souligne Véronique Cherfaoui, maître de conférences à l’UTC au sein au laboratoire Heudiasyc.

Échanges de savoir-faire

Jusqu’en 2015, les chercheurs ont multiplié les tests et les acquisitions de données, avec des approches différentes selon le pays. Les Chinois, soutenus par un gouvernement très motivé, multiplient les sorties sur les anneaux périphériques de Pékin en avançant au gré des échecs et des succès. En France, les essais sur route sont progressivement autorisés à certains véhicules, ce qui pousse les chercheurs à avancer de manière plus prudente, visant la réussite à chaque tentative.

développé avec nos

partenaires chinois

de nouvelles

méthodes de

compréhension de

scènes de conduite.

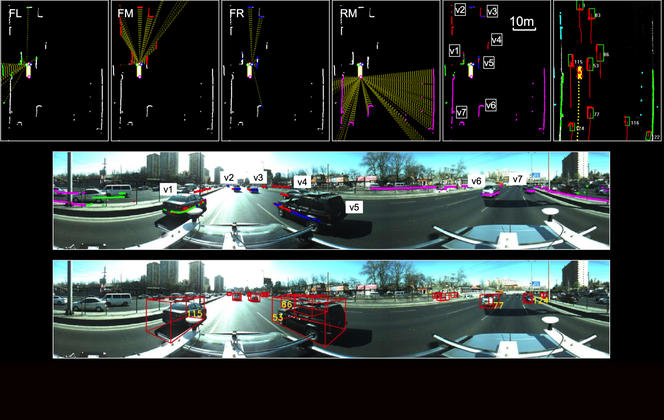

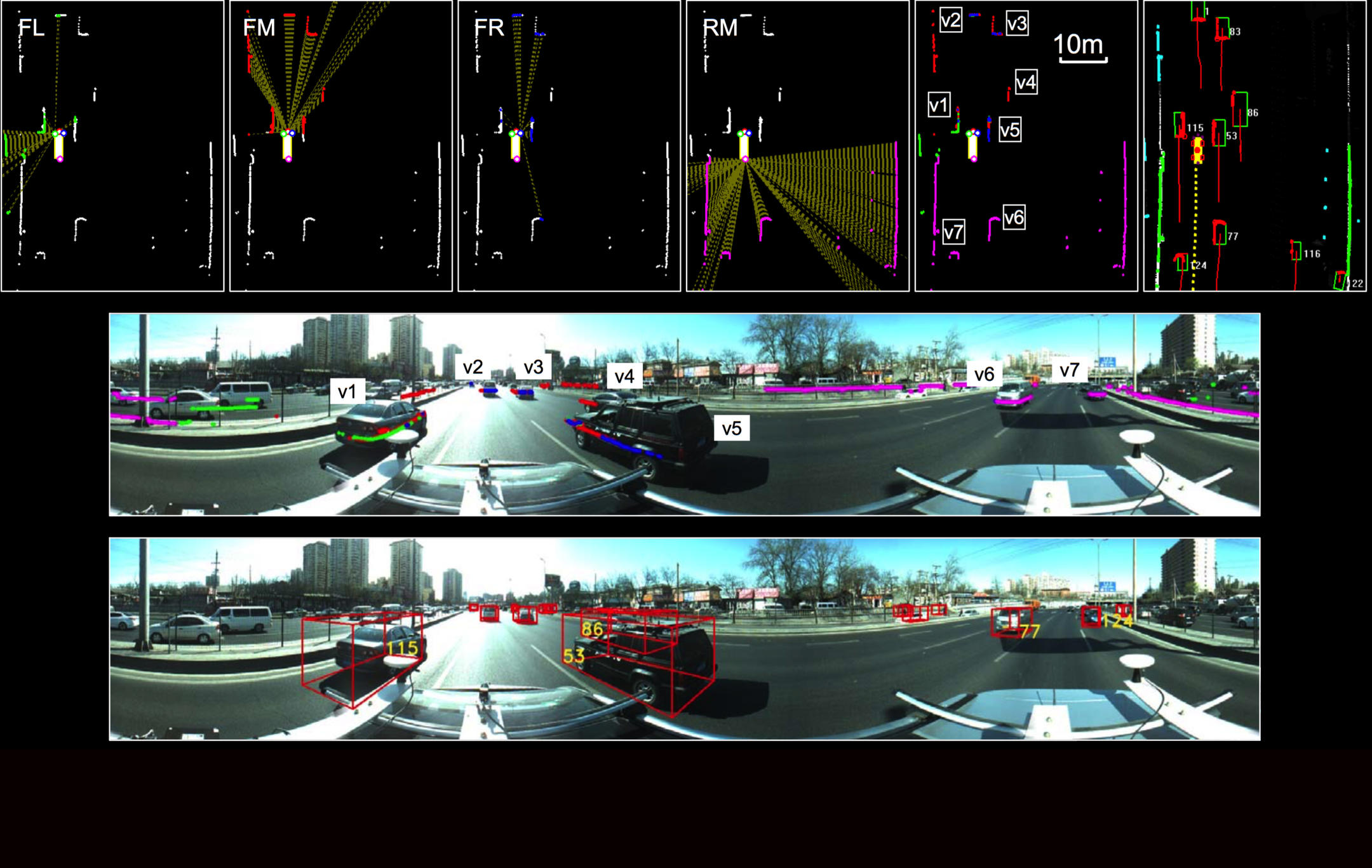

Au bout du compte, les résultats sont équilibrés et les échanges fructueux : « En matière de perception de l’environnement, nos partenaires chinois utilisent essentiellement des techniques avancées à base de capteurs laser, remarque Franck Davoine. De notre côté, nous avons apporté notre connaissance de la détection par caméras et avons conjointement développé de nouvelles méthodes de compréhension de scènes de conduite. » L’évaluation de ces méthodes nécessitera de nouvelles recherches.

Pour l’heure, Heudiasyc poursuit ses collaborations avec les universités de Pékin, Shanghai et Nankin. Le laboratoire développe en parallèle des solutions de conduite collaborative visant à étendre le champ de perception des véhicules à l’aide d’informations fournies par les autres usagers de la route et par l’infrastructure. Ces travaux font l’objet d’une équipe Défi interne au Labex MS2T qui a testé ses méthodes avec succès lors du challenge international GCDC2 2016, qui s’est déroulé aux Pays-Bas fin mai 2016.

Lire aussi: Y a-t-il un pirate dans l'avion ?

Voir aussi

Auteur

Formé à l’Institut de journalisme de Bordeaux et à l’école de photographie Efet, Guillaume Garvanèse est journaliste et photographe, spécialisé dans les domaines de la santé et du social. Il a notamment travaillé pour le groupe Le Moniteur.