Vous êtes ici

Armes létales autonomes: de quoi parle-t-on?

Une fois par mois, retrouvez sur notre site les Inédits du CNRS, des analyses scientifiques originales publiées en partenariat avec Libération.

Les « armes autonomes », quand ce ne sont pas les « robots-tueurs », font l’objet, depuis environ trois ans, de nombreux articles de presse, lettres ouvertes et débats, dont on constate le caractère sensationnel et anxiogène des arguments avancés, ainsi que la quasi-absence d’explications et d’arguments scientifiques et techniques. Depuis 2014, le débat est engagé à l’ONU à Genève, dans le cadre de la Convention sur certaines armes classiques (CCAC), sur la question d’une interdiction ou d’un moratoire sur le développement de telles armes.

Des mots à la réalité

Le vocable de « robot-tueur » suggère que le robot serait animé par l’intention de tuer, voire qu’il en serait conscient, ce qui n’a évidemment pas de sens pour une machine, quand bien même elle a été conçue et programmée pour détruire, neutraliser ou tuer : on ne parle pas, par exemple, de « missile-tueur ». Il s’agit là d’une rhétorique du pathos qui entrave par nature la discussion éthique, mais qui est utilisée pour rechercher un effet de rejet du public.

Le terme « autonome » est également problématique parce que les différentes parties prenantes, et en premier lieu les scientifiques, lui accordent des acceptions multiples. Une « arme autonome » peut ainsi désigner un engin qui réagit automatiquement à certains signaux prédéfinis, ou bien qui optimise sa trajectoire pour atteindre un objectif dont il aura reconnu automatiquement une signature prédéfinie, ou encore qui cherche automatiquement dans une zone donnée une cible spécifiée par certaines caractéristiques.

Plutôt donc que de parler d’ « arme autonome », il semble plus pertinent d’étudier quelles fonctions sont – ou pourront être – automatisées, c’est-à-dire assignées à des programmes informatiques, et avec quelles limitations, dans le cadre d’un partage de l’autorité avec un opérateur humain.

Les fonctions automatisées

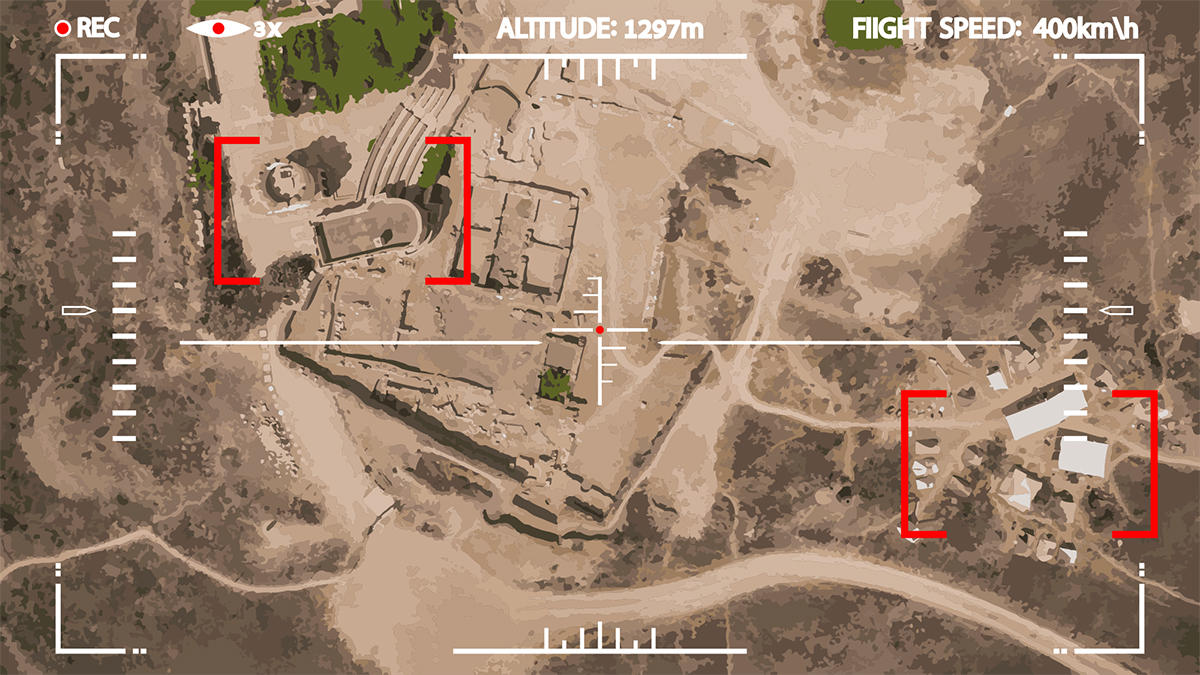

Les fonctions de guidage et de navigation sont depuis longtemps automatisées (pilotage automatique des avions ou des drones, par exemple) et n’ont pas soulevé de questionnement notable ; elles sont non critiques pour ce débat. Plus sensibles sont les fonctions d’identification et d’engagement (c’est-à-dire d’ouverture du feu) automatiques de cibles.

Les armes existantes, qui sont dotées de capacités de reconnaissance de cibles, sont équipées de logiciels qui comparent des signaux perçus par les capteurs (radio, radars, caméras, etc.) avec une base de signatures (modèles prédéfinis de cibles). Cela concerne en général de gros objets « faciles » à reconnaître (radars, bases aériennes, chars, batteries de missiles). L’engagement des cibles est réalisé sous supervision humaine. En revanche, ce type de logiciels ne permet pas d’évaluer la situation aux alentours de ces objets – par exemple, la présence de civils.

Reconnaître des cibles complexes

Les discussions et controverses actuelles portent sur le fait qu’une arme puisse être dotée de la capacité de reconnaître des cibles plus complexes (par exemple, des combattants par rapport à des blessés hors de combat), dans des situations et des environnements eux-mêmes complexes (par exemple, dans une situation évolutive), et de la capacité d’engager de telles cibles sur la seule base de cette reconnaissance.

De telles capacités supposeraient de disposer d’une description formelle (mathématique) des états possibles de l’environnement, des éléments d’intérêt et des actions à effectuer, sachant qu’il n’y a pas de situation type. Elles supposeraient également de reconnaître, à partir des capteurs, tel état, tel élément d’intérêt, et d’évaluer si les actions envisagées respectent les principes d’humanité (éviter les maux superflus), de discrimination (distinguer les objectifs militaires des populations et biens civils), et de proportionnalité (adéquation entre les moyens mis en œuvre et l’effet recherché) inscrits dans le droit international humanitaire (DIH). Les difficultés sont liées au fait de pouvoir comprendre automatiquement une situation sur la base de modèles mathématiques.

À qui revient la décision ?

Au-delà des aspects techniques et légaux, est-il éthiquement admissible que la décision de supprimer un être humain identifié par une machine soit confiée à cette machine ? Plus précisément, on doit se demander comment et par qui seraient établies la caractérisation, la modélisation et l’identification des objets d’intérêt, ainsi que la sélection de sous-ensembles d’informations (au détriment de certaines autres) pour calculer automatiquement la décision. Il s’agit également de savoir qui spécifierait ces algorithmes et comment il serait démontré qu’ils sont conformes aux conventions internationales et aux règles d’engagement, surtout s’ils sont capables d’apprentissage. En outre, qui devrait être responsable en cas de violation des conventions ou de détournement d’usage ? Car, au-delà des armes proprement dites, il est également important de réfléchir, lors de leur conception, aux potentiels détournements d’usage d’objets dits « autonomes » à des fins d’attaque. Par exemple, comment la voiture autonome ou le drone de loisir peuvent-ils être rendus robustes au piratage et à la modification malveillante ?

Définir un cadre

Face à ces questions, plusieurs organisations internationales appellent à ce qu’une arme dite « autonome » soit toujours sous contrôle humain significatif, c’est-à-dire que la décision d’engager une cible soit toujours prise par un être humain. D’un point de vue technique, il faut vérifier qu’un être humain dispose, en toutes circonstances, des informations suffisantes et du temps pour prendre cette décision, et cerner en quoi les informations calculées, sélectionnées et transmises par la machine influencent l’appréciation et la décision humaines.

Ainsi, les préconisations formulées par la « IEEE1 Global Initiative on Ethics of Autonomous and Intelligent Systems2 », qui portent sur l’ensemble des technologies des systèmes autonomes et intelligents, énoncent pour les systèmes d’armes létales autonomes quelques principes dont la prévisibilité, la traçabilité, ou l’identification claire des responsabilités humaines.

Les systèmes adaptatifs et apprenants devraient ainsi être conçus de sorte qu’ils puissent expliquer leur raisonnement et leurs décisions aux opérateurs humains de manière compréhensible, les opérateurs demeurant responsables de la mise en œuvre de ces dispositifs. De plus, des systèmes autonomes au comportement prévisible pourraient devenir imprévisibles dans un déploiement en essaim où un comportement émergent imprévu peut apparaître. Ce type d’usage devrait donc être proscrit.

Enfin, il faut souligner que si les armes autonomes peuvent aider à gagner une guerre, l’effet psychologique de leur usage sur les populations qui en seront victimes risque fort d’empêcher de gagner la paix.

Les points de vue, les opinions et les analyses publiés dans cette rubrique n’engagent que leur auteur. Ils ne sauraient constituer une quelconque position du CNRS.

Pour en savoir plus :

Vincent Boulanin et Maaike Verbruggen, Mapping the development of autonomy in weapon systems, Stockholm International Peace Research Institute (Sipri), novembre 2017.

- 1. Institute of Electrical and Electronics Engineers (Institut des ingénieurs électriciens et électroniciens), association professionnelle et scientifique internationale.

- 2. The IEEE Global Initiative on Ethics of Autonomous and Intelligent Systems. Ethically Aligned Design: A Vision for Prioritizing Human Well-being with Autonomous and Intelligent Systems, Version 2. IEEE, 2017. http://standards.ieee.org/develop/indconn/ec/autonomous_systems.html