Vous êtes ici

Marie-Paule Cani : « J’essaie de rendre l’humain plus créatif »

Cet entretien a été publié initialement dans le n° 14 de la revue Carnets de science.

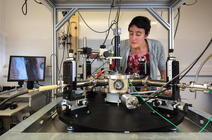

Sur votre page personnelle, il est dit que l’objectif de vos recherches est de créer une intelligence artificielle créative. De quoi s’agit-il ?

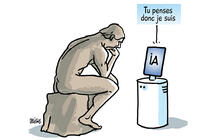

Marie-Paule Cani1. Il s’agit de rendre les humains plus créatifs grâce à des modèles intelligents. Je voudrais que l’utilisateur puisse créer ce qu’il a en tête avec l’aide de systèmes qui prennent en charge les tâches répétitives et ennuyeuses. Il ne s’agit pas du tout d’une intelligence artificielle (IA) qui crée à notre place. Je lutte contre ça depuis le début. Maintenant, quand les gens pensent à une IA créative, ils imaginent quelque chose comme Dall-E ou ChatGPT, des systèmes qui peuvent créer quelque chose à partir d’une phrase.

Avec ces applications, au lieu de prendre la peine de réfléchir à ce que l’on veut vraiment, on fait une espèce de copier-coller à partir de ce qui existe déjà. Ce n’est pas du tout le sens de mes recherches. Mon but est d’imaginer des systèmes intelligents qui aident l’utilisateur, un peu comme un assistant qui aide un chirurgien en lui tendant exactement le bon outil au bon moment.

Les tâches de création sont parmi les plus intéressantes sur Terre, alors pourquoi les laisser à une machine ? Déléguons-lui plutôt les tâches fastidieuses, celles que nous n’aimons pas faire.

Comment aidez-vous les créateurs à se concentrer sur les tâches de création ?

M.-P. C. En leur donnant des instruments pour travailler tout en restant dans le flot de la création. Au lieu d’ouvrir un menu, puis un sous-menu pour éditer tel ou tel paramètre, je veux que l’utilisateur puisse créer par gestes. Un exemple que je donne souvent : imaginons qu’on est en train de créer une table avec des assiettes, des couverts, des verres. Maintenant, je veux que la table soit plus longue. Je veux, d’un seul geste, pouvoir la rallonger. Le système intelligent doit se rendre compte qu’il y a des détails répétitifs, comme les assiettes et les couverts, qu’il faut dupliquer et non pas étirer. Ensuite, je peux aller modifier localement, affiner des détails, sans que tout le reste soit modifié. L’idée est d’interpréter les gestes de création des utilisateurs. Ils n’ont ainsi pas à se confronter à la complexité des modèles informatiques.

Les créateurs de jeux vidéo et de films d’animation utilisent les outils que vous développez. Comment identifiez-vous leurs besoins ?

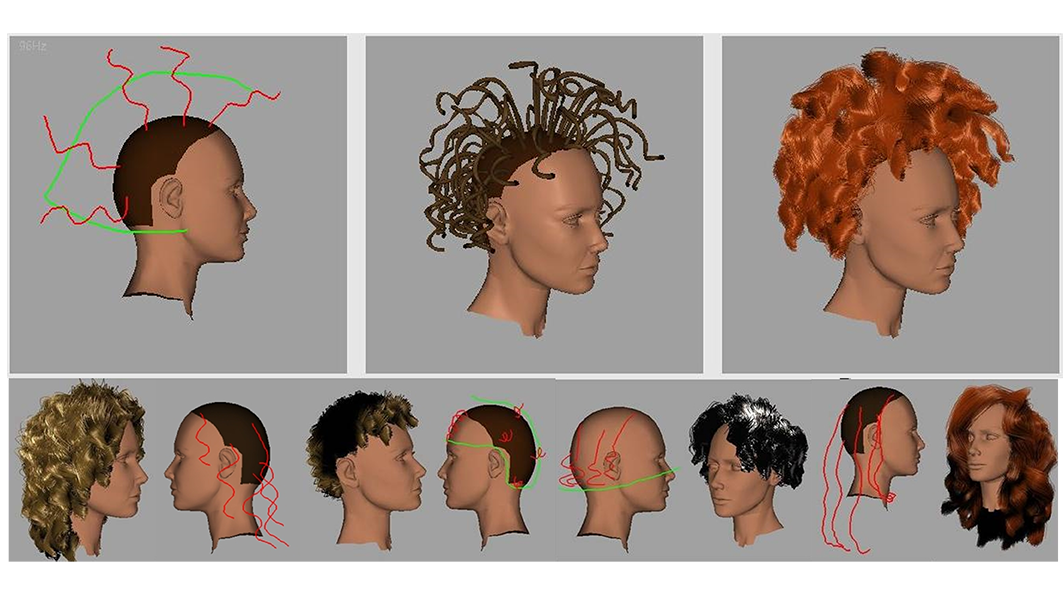

M.-P. C. C’est en regardant travailler les artistes, en les écoutant nous expliquer sur quoi ils passent le plus de temps, ce qui les ennuie le plus, qu’on trouve des méthodes pour leur simplifier la tâche. Par exemple, durant mon année sabbatique en Nouvelle-Zélande, en 2007, j’ai été invitée chez Weta Digital2, studio d’effets spéciaux fondé par le réalisateur Peter Jackson. Ils m’ont alors parlé du film King Kong qu’ils venaient de terminer. Il y avait là un artiste infographiste qui plantait à la main les touffes de poils virtuelles de King Kong et les peignait pour que la fourrure ait l’air naturelle et un peu emmêlée. C’était une tâche très répétitive qui lui prenait des jours et des jours. Ce serait plus simple que l’utilisateur puisse créer un petit exemple de fourrure ébouriffée puis, d’un seul geste, qu’il puisse l’étendre sur toute la surface du modèle virtuel.

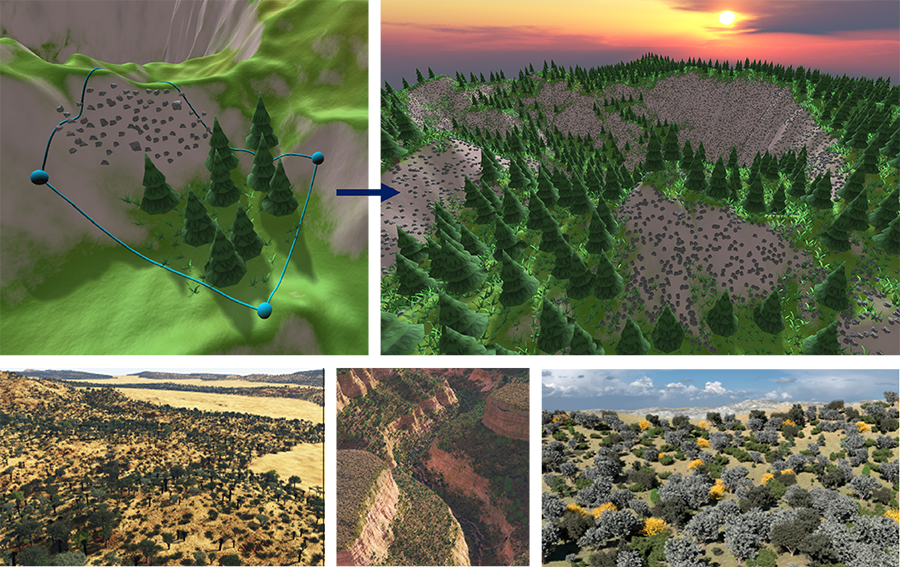

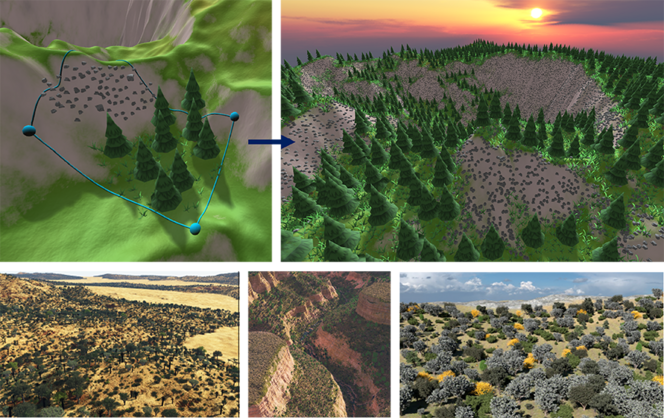

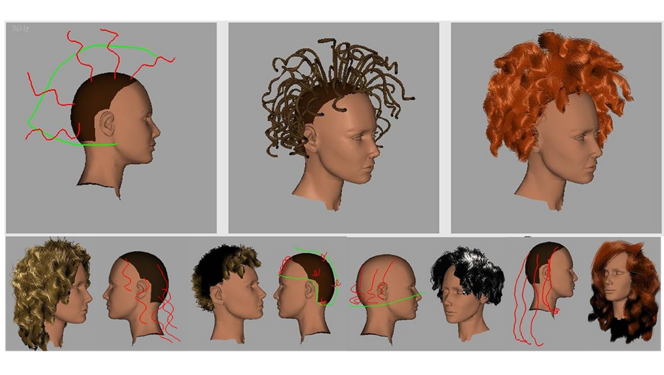

Au labo nous avons créé ce genre de système de copier-coller intelligent. Notre outil Worldbrush permet ainsi de prendre un échantillon de paysage virtuel, puis de le répliquer, non pas à l’identique, mais avec les mêmes caractéristiques statistiques. Par ailleurs, un ancien étudiant de mon équipe qui a travaillé chez Weta nous a dit que notre système de modélisation par croquis de chevelures a été utilisé pour le premier film Avatar.

Sur quels autres éléments graphiques pouvez-vous aider les créateurs d’effets spéciaux ?

M.-P. C. À Weta, ils nous avaient dit également que leurs artistes n’arrivaient pas à bien faire le design des montagnes. Ils voulaient des montagnes réalistes dont on puisse dessiner les silhouettes facilement, à l’arrière-plan derrière les acteurs. Cela a conduit à l’un de nos articles de recherche où l’on développait une méthode pour prendre un paysage existant et le déformer depuis le point de vue de la caméra de manière réaliste. De cette façon, on obtenait la prise de vue souhaitée.

N’avez-vous jamais eu envie de participer plus directement à la création d’un film ?

M.-P. C. Je n’ai pas le temps ! Ceux qui participent à ces créations passent un an de leur vie à faire une chose particulière. Moi, en général, j’ai entre cinq et dix projets en cours avec différents étudiants et collaborateurs scientifiques, en France ou à l’étranger. On explore différentes pistes en parallèle. Cette liberté, je l’ai parce que je ne fais pas partie d’une entreprise ou d’une start-up. Lorsque vous animez un personnage qui marche sur la neige, une robe qui tourne ou encore une coulée de lave, vous devez ajouter des connaissances physiques aux modèles.

Comment procédez-vous ?

M.-P. C. Pour créer un monde virtuel avec des lois réalistes, il faut se fonder sur ces connaissances physiques. En informatique graphique, ça fait trente ans qu’on utilise nos connaissances du monde réel pour concevoir des modèles et des simulations. L’originalité de mon approche est de voir comment des connaissances plus génériques pourraient être utilisées pendant des phases de création. Par exemple, prenons un biologiste qui veut un système pour faire des croquis animés fonctionnant à toutes les échelles, de l’organisme entier jusqu’à la simple cellule. Il y a des règles de répétitivité et des principes simples pour le mouvement et les déformations. Par exemple, la conservation du volume ou de l’aire de surface. Celles-ci permettent d’aller vers un tel outil générique.

Vous développez aussi des outils avec des chercheurs de diverses disciplines. Comment se déroule cette collaboration ?

M.-P. C. D’une part, je cherche à extraire leurs connaissances de très haut niveau sur un phénomène afin de les reproduire dans un monde virtuel. D’autre part, les chercheurs servent d’inspirateurs et de testeurs pour des systèmes de création. Il peut s’agir par exemple d’un système grâce auquel ils peuvent dessiner un croquis expliquant un phénomène et qui se transforme directement en une scène 3D animée. Nous avons ainsi travaillé avec un professeur d’anatomie. L’idée était qu’à partir d’un croquis en deux dimensions d’un organe, il puisse obtenir un modèle en 3D autour duquel on peut tourner, zoomer pour ajouter des détails, ou au contraire dézoomer pour montrer la place d’un organe dans le corps humain.

Qu’est-ce qui vous a amenée dans un domaine de recherche si lié à l’art ? Aviez-vous une vocation artistique ?

M.-P. C. Depuis que je suis petite j’aime dessiner, sculpter, fabriquer. Je créais de petits mondes faits de petits personnages en pâte à modeler avec des squelettes en fil de fer. J’ai retrouvé tout cela dans ma recherche, avec en plus la possibilité de les voir s’animer sous mes yeux ! Mais je n’avais pas de réelle vocation artistique, plutôt une vocation à la création. Et l’informatique en est devenu l’outil. Je conseille souvent aux jeunes de réfléchir à ce qu’ils ont toujours aimé faire et de le mettre dans leur métier.

Parlez-nous de votre parcours.

M.-P. C. Comme j’étais bonne élève et que j’avais une grande sœur très littéraire, ma mère m’a poussée vers les études scientifiques. Je me suis retrouvée en classe prépa et j’ai eu la chance d’entrer à l’École normale supérieure. J’ai passé l’agrégation de mathématiques, puis j’ai décidé d’aller vers une discipline qui, en 1986-1987, émergeait à peine : l’informatique graphique. La première chose que j’ai voulu faire a été de produire des scènes et des objets naturels dans ces mondes qu’on pouvait créer. À l’époque, les jeux vidéo avaient un caractère presque carcéral : on entrait dans un château, la pièce était généralement vide, alors on passait à la suivante qui était également vide. De plus, on ne savait pas faire des scènes naturelles, pour se promener à l’extérieur.

Tout cela présente un fort aspect ludique. Est-ce quelque chose d’important pour vous ?

M.-P. C. Oui, tout à fait. Petit à petit, je mets dans les algorithmes les éléments qui vont me permettre de créer un monde virtuel que j’imagine. C’est intéressant parce que, en créant cet univers, je suis en train de créer en même temps le média qui me permet de m’exprimer. C’est comme si j’étais un peintre et qu’en plus d’un tableau, j’étais en train de créer la meilleure toile, la meilleure peinture et les meilleurs pinceaux.

C’est comme cela que ça se passait à la Renaissance, lorsque les peintres faisaient des expériences pour améliorer leurs pigments.

M.-P. C. Tout à fait ! C’est d’ailleurs de la cocréation comme dans un atelier de peintre. Quand on travaille en équipe, on partage nos méthodes et on réfléchit ensemble, on crée ensemble.

Comment voyez-vous l’évolution de votre domaine. Quels sont les nouveaux risques et défis ?

M.-P. C. Beaucoup de gens commencent à découvrir ces mondes virtuels animés sur lesquels nous travaillons depuis trente ans, au travers du terme Métavers. Mais si le Métavers devient une espèce de terrain commercial limité où tout est payant et coûteux pour la planète à cause de la 5G3 et de la blockchainFermer ou chaîne de blocs en français. Sorte de livre de compte numérique qui enregistre toutes les actions, par exemple les déplacements de jetons de compte en compte dans le cas des cryptomonnaies, je n’en vois pas l’intérêt. Pourquoi consacrer de l’énergie du monde réel pour mettre ça en place ? Moi, je lutte pour des mondes virtuels qui ont un sens. Par exemple, permettre aux préhistoriens de voyager dans le temps et de s’immerger dans le résultat de leurs hypothèses. Si nos recherches peuvent servir à donner du sens au Métavers, là je suis d’accord. Un autre risque est que l’humanité perde une partie de ses capacités créatives.

De plus en plus de personnes, en particulier des chercheurs, utilisent en effet l’apprentissage profondFermer Classe d'algorithmes d'apprentissage automatique, à partir de données, sans production explicite de règles et utilisant des réseaux de neurones. On les qualifie souvent de "boîte noire" car la raison pour laquelle ils parviennent au résultat est inconnue. Les neurones en question sont des fonctions mathématiques qui, à partir des valeurs numériques reçues en entrée, calculent une valeur numérique de sortie. (ou deep learning) pour résoudre quantité de problèmes. On perd donc les modèles fondés sur les connaissances au profit de modèles qui apprennent à partir de millions d’exemples. Et, de cette façon, on perd aussi la capacité d’expliquer les résultats. À l’avenir, j’espère que nous aurons des systèmes intelligents qui combinent les connaissances existantes avec un peu d’apprentissage, de manière à faire quelque chose de vraiment efficace. Et qui aide l’humain à se consacrer uniquement aux tâches les plus intéressantes. ♦

- 1. Chercheuse au Laboratoire d’informatique de l’École polytechnique (CNRS/École polytechnique) et professeure à l’École polytechnique. Elle a reçu la médaille d’argent du CNRS en 2012 et est membre de l’Académie des sciences.

- 2. Weta Digital (aujourd’hui WetaFX) a notamment participé à la création des effets spéciaux des films Avatar (2009), Mulan (2020), de la série de films Le Seigneur des anneaux, ou encore la série télévisée Game of Thrones (2011-2019).

- 3. Le Haut Conseil pour le climat a estimé en 2020 que la norme de réseau cinquième génération (5G) aurait un impact négatif sur les émissions de gaz à effet de serre, en particulier en raison de la production de nouveaux terminaux (smartphones, tablettes, etc.) et d’équipements de réseau.