Vous êtes ici

Pour une éthique de la recherche en robotique

Attisant les imaginations à travers les œuvres d’anticipation depuis l’Antiquité, interpellant l’homme sur sa nature même, souvent mal vulgarisée par les médias, la robotique est un domaine en plein essor et les articles de presse évoquant les robots sont quasiment quotidiens. En effet, l’avancée des recherches ainsi que les développements technologiques ont permis de parvenir à une maturité suffisante pour que certaines applications concrètes commencent à voir le jour. Au-delà du contexte manufacturier déjà ancien, des robots ou des techniques issues de la robotique sont dorénavant présents dans plusieurs secteurs comme l’exploration planétaire, l’agriculture, la médecine et la chirurgie, la défense ou les transports. D’autres applications restent encore à venir. La recherche en robotique reste cependant encore largement ouverte.

Inciter les chercheurs à s’interroger sur les conséquences de leurs travaux

Comme toute nouvelle technique arrivant dans la société, la robotique porte en germe une multiplicité d’usages, parfois imprévisibles, qui peuvent mettre en question les normes juridiques admises et provoquer des questionnements moraux ou éthiques. À ce titre, elle nécessite de mener quelques réflexions et de prendre quelques précautions dès la conception des recherches ; non pour fixer au chercheur un cadre normatif strict (ce qui serait d’ailleurs illusoire) qui briderait sa créativité, mais pour lui suggérer de s’interroger sur les conséquences de ses choix et de ses travaux et d’adopter une démarche responsable.

Il est donc assez naturel que la première saisine de la Commission de réflexion sur l’éthique de la recherche en sciences et technologies du numérique d’Allistene1 (Cerna) traite de la robotique. Après deux années de travaux, celle-ci vient de rendre son premier avis, qui a été remis à la secrétaire d’État à l’Enseignement supérieur et à la Recherche, Geneviève Fioraso, le 6 novembre dernier.

Cet avis est composé de 17 préconisations propres à la robotique et de 9 préconisations concernant les sciences du numérique en général qui ont été élaborées au cours de la réflexion sur la robotique, mais dont la portée est plus globale. Ces préconisations s’adressent au « chercheur » au sens large, c’est-à-dire aux praticiens, individus ou équipes, dont les travaux se situent en amont des applications techniques, ainsi qu’à leurs établissements.

La commission a commencé par élaborer une définition du robot et de la robotique afin de circonscrire le champ de ses réflexions. Celui-ci concernera ainsi le robot matériel qui agit et interagit dans le monde physique (à l’exclusion donc de programmes rapides de traitement de l’information sur la Toile, parfois appelés robots ou « bots », ou d’entités virtuelles). La commission a analysé des cas d’usage de la robotique, en particulier les robots auprès des personnes (comme les robots compagnons) et au sein des groupes, les robots dans le contexte médical et les robots dans la défense et la sécurité. Elle a identifié trois grands thèmes de recherche traversant les applications et les domaines d’usage sur lesquels des préconisations éthiques ont été élaborées : l’autonomie et les capacités décisionnelles (7 préconisations), l’imitation du vivant et l’interaction affective et sociale avec les humains (6 préconisations) et la réparation et l’augmentation de l’humain par la machine (4 préconisations).

Trois exemples de préconisation

Considérons trois exemples. L'une des préconisations rappelle que « le chercheur doit être attentif à évaluer les programmes de perception, d’interprétation et de prise de décision et à en expliciter les limites. En particulier, les programmes qui visent à conférer une conduite morale au robot sont soumis à de telles limites ». Il s’agit de souligner ici que l’incomplétude et les incertitudes qui entachent les données et les résultats des programmes informatiques de traitement et de raisonnement limitent nécessairement la confiance que l’on doit leur accorder et que cela doit être explicitement évalué et énoncé. D’autant plus que certains travaux prétendent pouvoir doter des systèmes robotiques de capacités de décision fondées sur des « règles morales ».

des dispositifs robotiques visant l’augmentation

de l’homme par

la machine, le chercheur veillera

à la réversibilité

de celle-ci.

Un certain nombre de travaux en robotique visent à imiter le vivant, y compris l’expression d’émotions. La Cerna considère que le chercheur devra s’interroger sur la nécessité de cet objectif et étudier « au regard des fonctions utiles du robot, la pertinence et la nécessité de susciter des émotions » et « du comportement biomimétique ». Elle ajoute que, « si une ressemblance quasi parfaite est visée, le chercheur doit avoir conscience que la démarche biomimétique peut brouiller la frontière entre un être vivant et un artefact. Le chercheur consultera sur ce brouillage le comité opérationnel d’éthique de son établissement ».

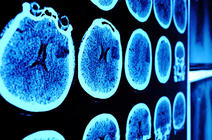

Pour ce qui concerne la robotique médicale, la Cerna en réfère d’abord à l’éthique médicale. Mais, s’il s’agit de l’augmentation de l’homme par la machine, elle affirme que, « dans le cas des dispositifs robotisés visant l’augmentation, le chercheur veillera à la réversibilité de celle-ci : les dispositifs doivent être amovibles, sans dommage pour la personne, autrement dit, sans que la personne perde l’usage de ses fonctions initiales ».

Ces préconisations de la Cerna devront être diffusées sur le plan national, mais aussi partagées par les chercheurs dans le monde (une version anglaise sera préparée à cette fin). Leur véritable valeur ne pourra être reconnue que si les acteurs de la recherche les adoptent. La recherche avançant, de nouvelles questions seront probablement posées. Il sera important d’évaluer la mise en œuvre de ces préconisations et de les compléter en fonction des pratiques.

- 1. L’Alliance des sciences et technologies du numérique (CDEFI/CEA/CNRS/CPU/Inria/Institut Mines-Telecom).